WF-VAE: Улучшение Видео VAE с помощью Энергетического Потока на Основе Вейвлетов для Моделей Диффузии Видео в Латентном Пространстве

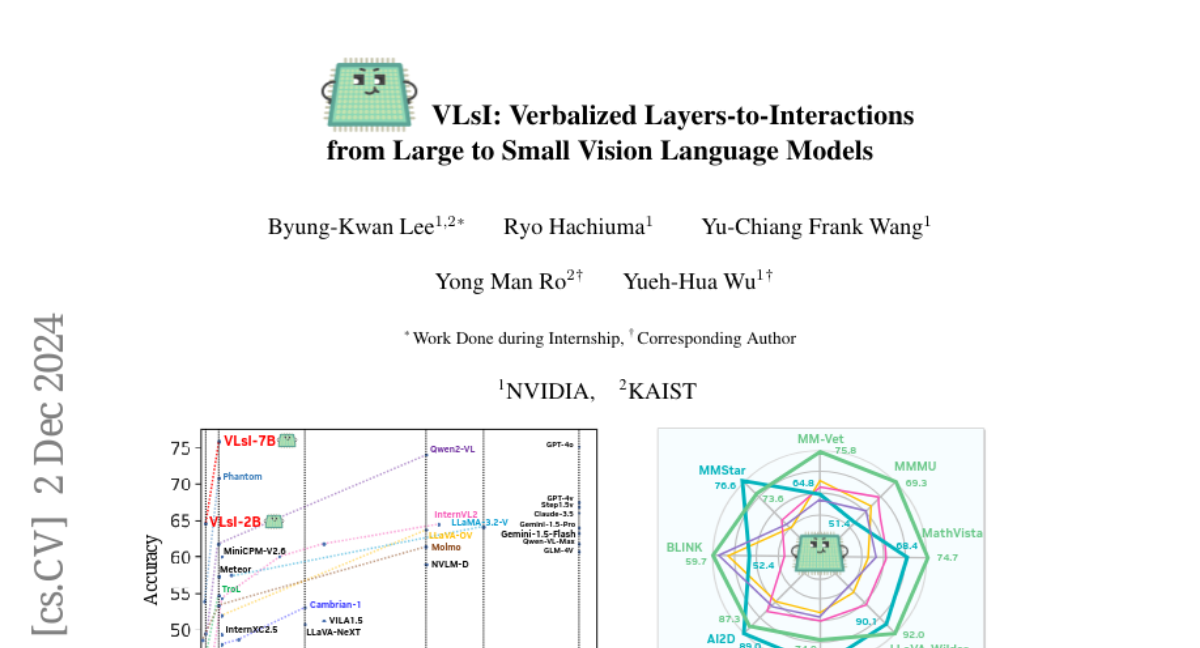

Видеографический вариационный автокодировщик (VAE) кодирует видео в низкоразмерное латентное пространство, становясь ключевым компонентом большинства латентных моделей диффузии видео (LVDM), чтобы снизить затраты на обучение модели. Однако, с увеличением разрешения и длительности генерируемых видео, стоимость кодирования видеографических VAE становится ограничивающим фактором при обучении LVDM. Более того, метод блокового инференса, используемый большинством LVDM, может привести к дискретности латентного пространства при обработке длинных видео. Ключ к решению вычислительного узкого места заключается в разбиении видео на отдельные компоненты и эффективном кодировании критической информации. Преобразование вейвлетов может разложить видео на несколько компонент в частотной области и значительно повысить эффективность, поэтому мы предлагаем Wavelet Flow VAE (WF-VAE), автоэнкодер, который использует многоуровневое вейвлет-преобразование для облегчения потока низкочастотной энергии в латентное представление. Кроме того, мы вводим метод под названием Causal Cache, который поддерживает целостность латентного пространства во время блокового инференса. По сравнению с современными видеографическими VAE, WF-VAE демонстрирует превосходные результаты как по метрике PSNR, так и по метрике LPIPS, достигая в 2 раза более высокой пропускной способности и в 4 раза меньшего потребления памяти при сохранении конкурентоспособного качества реконструкции. Наш код и модели доступны по адресу https://github.com/PKU-YuanGroup/WF-VAE.