Меньшие языковые модели лучше эволюционеров инструкций

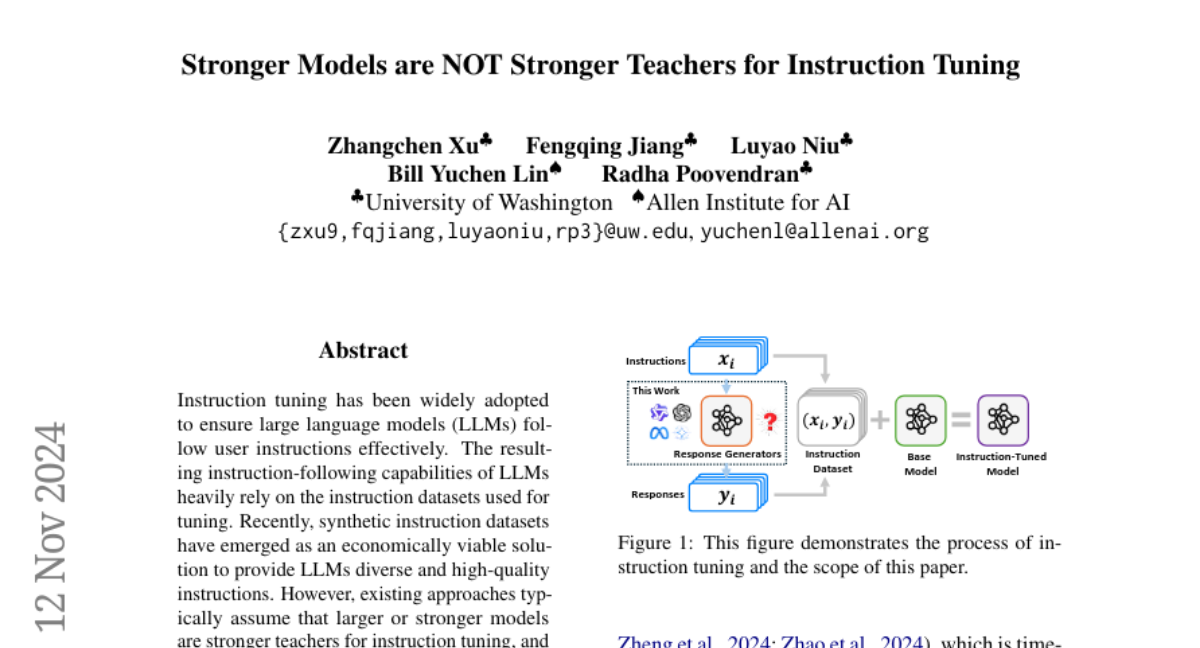

Настройка инструкций широко используется для раскрытия полного потенциала больших языковых моделей. Примечательно, что сложные и разнообразные инструкции имеют значительное значение, так как они могут эффективно согласовывать модели с различными задачами. Тем не менее, текущие подходы к созданию масштабных инструкций преимущественно отдают предпочтение мощным моделям, таким как GPT-4 или тем, у которых более 70 миллиардов параметров, основываясь на эмпирическом предположении о том, что такие большие языковые модели (LLM) по своей сути обладают улучшенными возможностями. В данном исследовании мы ставим под сомнение это распространенное предположение и проводим глубокое исследование потенциала меньших языковых моделей (SLM) в контексте эволюции инструкций. Обширные эксперименты в трех сценариях эволюции инструкций показывают, что меньшие языковые модели (SLM) могут синтезировать более эффективные инструкции, чем LLM. Дальнейший анализ демонстрирует, что SLM обладают более широким пространством выходов во время эволюции инструкций, что приводит к более сложным и разнообразным вариантам. Мы также отмечаем, что существующие метрики не акцентируют внимание на воздействии инструкций. Таким образом, мы предлагаем IFD с учетом сложности инструкции (IC-IFD), который вводит сложность инструкции в оригинальную оценку IFD для более точной оценки эффективности данных инструкций. Наш исходный код доступен по адресу: https://github.com/HypherX/Evolution-Analysis