ACDIT: Интерполирующая Автогрегрессионная Условная Модель и Диффузионный Трансформер

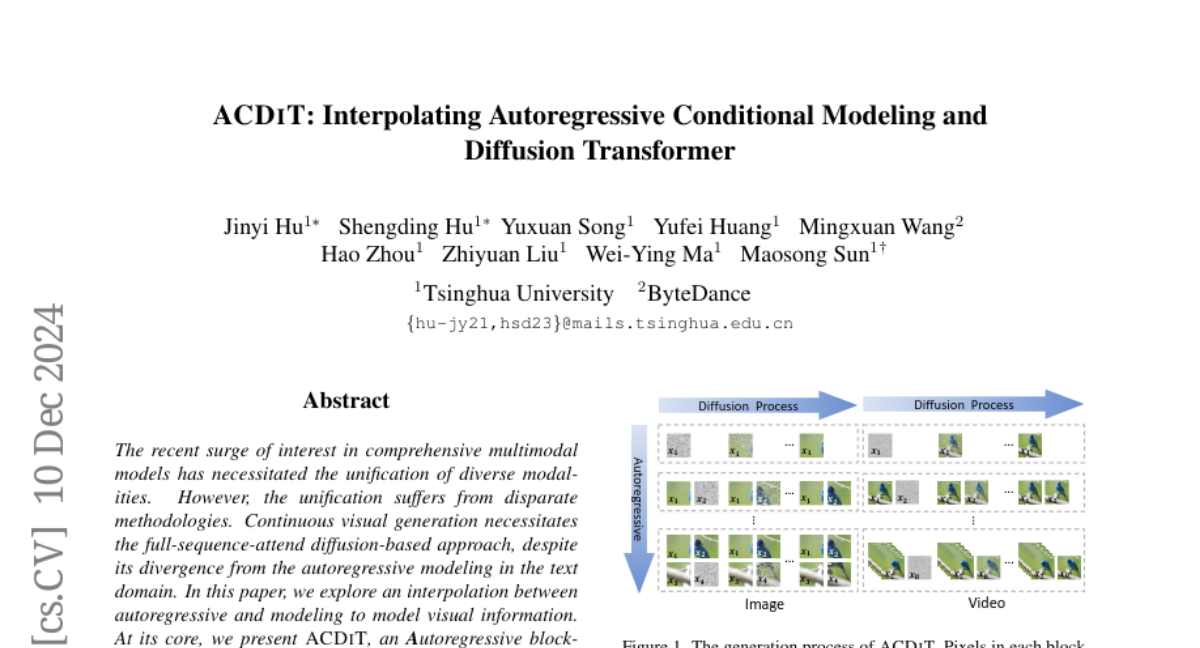

Недавний рост интереса к комплексным мультимодальным моделям потребовал объединения различных модальностей. Однако объединение страдает от разрозненных методологий. Непрерывная визуальная генерация требует применения подхода на основе диффузии полной последовательности, несмотря на его отличия от авторегрессионного моделирования в текстовой области. Мы предполагаем, что авторегрессионное моделирование, то есть предсказание будущего на основе прошлого детерминированного опыта, остается ключевым в разработке как модели визуальной генерации, так и потенциальной объединенной мультимодальной модели. В этой статье мы исследуем интерполяцию между авторегрессионным моделированием и диффузией с полными параметрами для моделирования визуальной информации. В своей основе мы представляем ACDiT, авторегрессионный блочно-условный трансформер диффузии, где размер блока диффузии, то есть размер авторегрессионных единиц, можно гибко регулировать для интерполяции между токеновой авторегрессией и диффузией полной последовательности. ACDiT легко реализовать, настолько же просто, как создание маски внимательности с пропусками (SCAM) во время обучения. Во время интерференции процесс итеративно чередуется между денойзингом диффузии и авторегрессионным декодированием, что позволяет в полной мере использовать KV-кэш. Мы проверяем эффективность ACDiT на задачах генерации изображений и видео. Мы также демонстрируем, что, благодаря авторегрессионному моделированию, ACDiT можно бесшовно использовать в задачах визуального понимания, несмотря на то что он обучался на объективе диффузии. Анализ компромисса между авторегрессионным моделированием и диффузией демонстрирует потенциал ACDiT для использования в задачах визуальной генерации на длительные горизонты. Эти сильные стороны делают его многообещающим как основу для будущих объединенных моделей.