Вы видите это, вы получили это: Обучение 3D-креации на видео без позы в масштабе

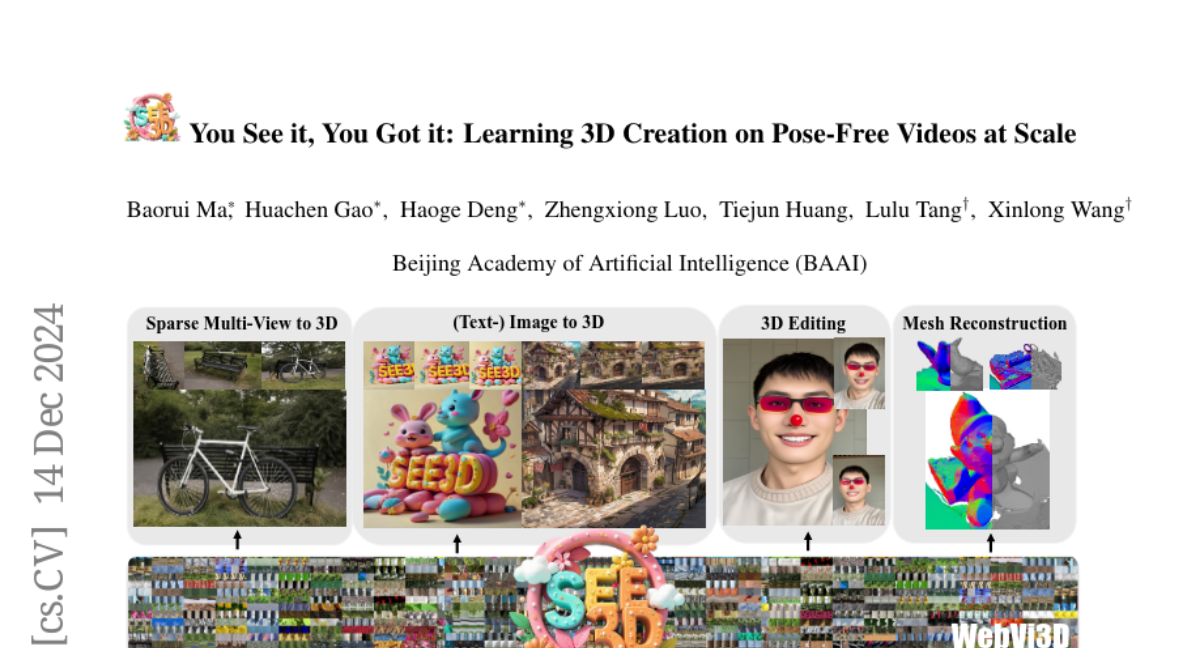

Современные достижения в области 3D-генерации играют важную роль в таких областях, как виртуальная реальность, развлечения и симуляция. Эти технологии открывают новые горизонты для воссоздания сложных структур реального мира и расширения человеческого воображения. Тем не менее, разработка моделей 3D-генерации ограничена нехваткой доступных 3D-датасетов и высокими затратами на их создание. В этой статье мы рассмотрим новую модель под названием See3D, которая использует масштабируемые видеоданные из Интернета для создания 3D-контента без необходимости в аннотациях позы.

Проблема

Текущие модели генерации 3D-контента часто зависят от ограниченных 3D-датасетов с высококачественными аннотациями. Эти аннотации, как правило, требуют значительных временных и финансовых затрат, что делает их труднодоступными для исследовательских групп. В то же время, видео, доступные в Интернете, представляют собой богатый источник многовидовых изображений, которые могут быть использованы для обучения моделей 3D-генерации. Однако, чтобы эффективно использовать эти данные, необходимо решить две ключевые проблемы:

- Фильтрация данных: Необходимо отфильтровать видео, чтобы оставить только те, которые содержат статические сцены с достаточным количеством наблюдений из разных ракурсов.

- Обучение без аннотаций позы: Традиционные подходы требуют точных аннотаций позы, что делает их сложными для масштабирования.

Подход

See3D представляет собой визуально-условную многовидовую диффузионную модель, которая обучается на масштабируемых видеоданных без аннотаций позы. Основная идея заключается в том, что модель может извлекать 3D-знания, просто анализируя визуальный контент из огромного количества видео. Для достижения этой цели была разработана новая стратегия фильтрации данных, которая автоматически отбирает видео с динамическим содержанием и ограниченными ракурсами.

Курация данных

Курация данных для создания датасета WebVi3D включает несколько этапов:

- Темпоральное и пространственное понижение разрешения: Каждый видеоклип понижается как по времени, так и по пространству, чтобы улучшить эффективность фильтрации.

- Семантическое распознавание динамики: Используя модели сегментации, такие как Mask R-CNN, отсеиваются видео с динамическими объектами.

- Фильтрация динамических областей: Оценка оптического потока позволяет точно идентифицировать и исключить видео с динамическими регионами.

- Фильтрация по малым ракурсам: Отслеживание ключевых точек по кадрам помогает определить, содержат ли видео достаточное количество различных ракурсов.

В результате этих этапов был создан датасет WebVi3D, содержащий 320 миллионов кадров из 15.99 миллионов видеоклипов. Этот датасет значительно превосходит по размеру предыдущие 3D-датасеты, что открывает новые возможности для обучения моделей.

Визуально-условная многовидовая диффузионная модель

See3D использует визуально-условные сигналы, которые формируются путем добавления временно-зависимого шума к маскированным данным видео. Это позволяет модели обучаться, не полагаясь на аннотации позы. Визуально-условные сигналы являются 2D-индуктивными визуальными сигналами, которые обеспечивают достаточно информации для генерации 3D-контента. Модель обучается на основе диффузионного процесса, который включает в себя обучение обратному процессу генерации, что позволяет создавать новые виды на основе заданных ракурсов.

Применение

See3D демонстрирует свою эффективность в различных задачах 3D-креации, включая:

- Генерация из одного вида: Модель может создавать 3D-контент на основе одного входного изображения, обеспечивая высокое качество и точность.

- Реконструкция из разреженных видов: See3D показывает выдающиеся результаты в реконструкции 3D-сцен из ограниченного числа видов.

- 3D-редактирование: Модель поддерживает редактирование 3D-сцен, позволяя пользователям вносить изменения в существующий контент.

Результаты

Эксперименты показывают, что See3D превосходит существующие модели по всем метрикам, включая PSNR, SSIM и LPIPS. Это подтверждает, что модель способна генерировать высококачественные и реалистичные 3D-сцены, сохраняя при этом пространственную согласованность.

Заключение

See3D представляет собой значительный шаг вперед в области 3D-генерации, предлагая доступный и масштабируемый подход к созданию 3D-контента из видео без необходимости в аннотациях позы. Это открывает новые возможности для исследовательских групп и индустрии, позволяя создавать 3D-контент быстрее и с меньшими затратами. Мы надеемся, что этот подход вдохновит дальнейшие исследования в области 3D-генерации и поможет преодолеть текущие ограничения, связанные с доступностью 3D-данных.