Morph: Бездвижный Фреймворк Оптимизации Физики для Генерации Человеческого Движения

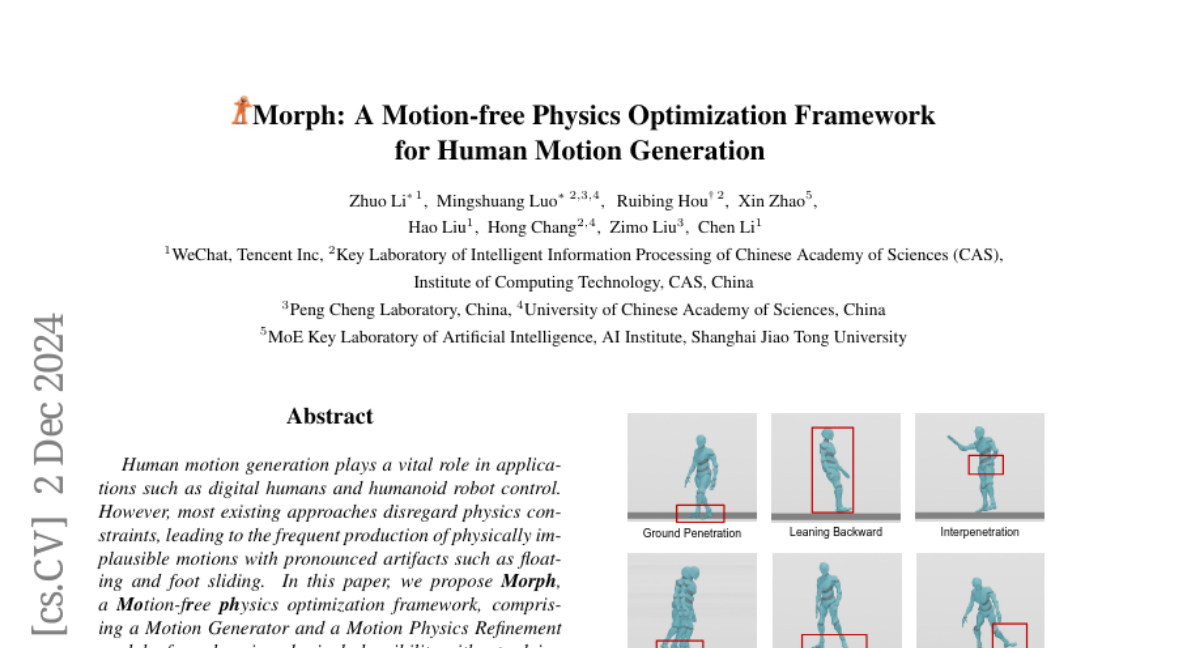

Генерация человеческого движения играет жизненно важную роль в таких приложениях, как цифровые люди и управление гуманоидными роботами. Однако большинство существующих подходов игнорируют физические ограничения, что приводит к частому производству физически неправдоподобных движений с выраженными артефактами, такими как зависание и скольжение ног. В этой работе мы предлагаем Morph, систему оптимизации физики без движения, состоящую из генератора движений и модуля уточнения физики движений, для повышения физической правдоподобности без необходимости полагаться на дорогие данные реального мира. В частности, генератор движений отвечает за предоставление синтетических данных о движениях в большом масштабе, в то время как модуль уточнения физики движений использует эти синтетические данные для обучения имитатора движений в физическом симуляторе, обеспечивая физические ограничения для проекции шумных движений в физически правдоподобное пространство. Эти физически уточненные движения, в свою очередь, используются для дальнейшей тонкой настройки генератора движений, что дополнительно повышает его возможности. Эксперименты по задачам генерации текста в движение и музыки в танец показывают, что наша система достигает качественного уровня генерации движений, сохраняя при этом значительное улучшение физической правдоподобности.