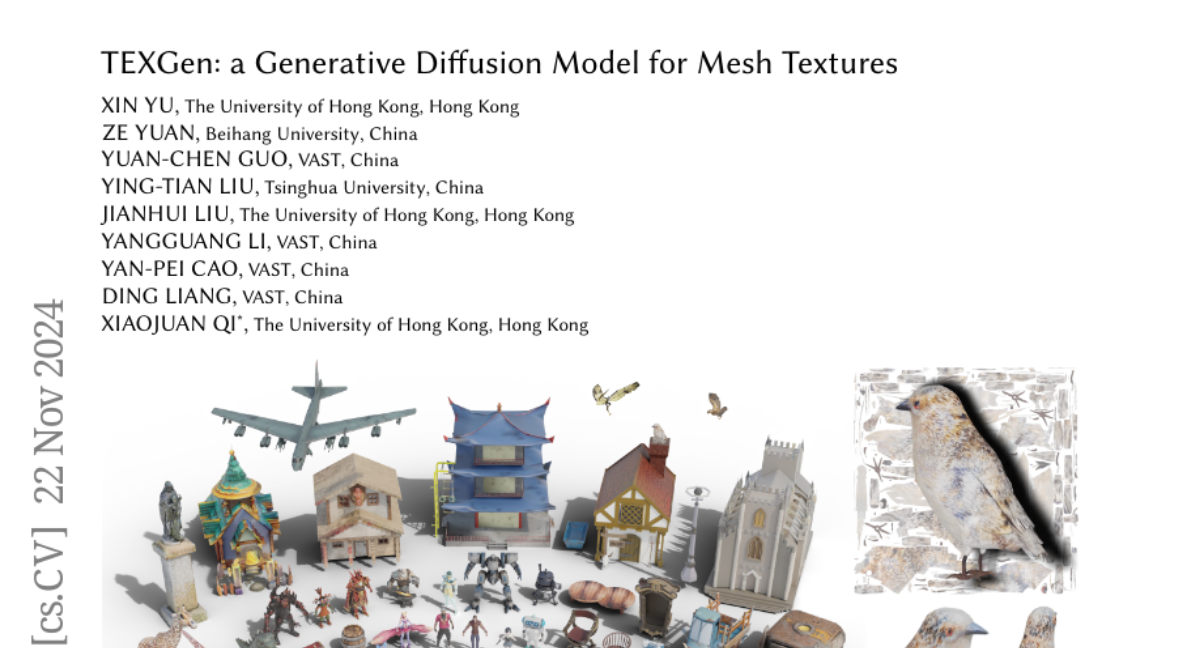

TEXGen: Генеративная модель диффузии для текстур сеток

Хотя высококачественные текстурные карты необходимы для реалистичного рендеринга 3D активов, мало исследований посвящено изучению непосредственно в пространстве текстур, особенно на больших наборах данных. В этой работе мы отходим от традиционного подхода, который полагается на предварительно обученные 2D модели диффузии для оптимизации текстур 3D в режиме тестирования. Вместо этого мы сосредотачиваемся на фундаментальной проблеме обучения в самом UV-пространстве текстур. Впервые мы обучаем большую модель диффузии, способную напрямую генерировать текстурные карты высокого разрешения в режиме прямого прохода. Для обеспечения эффективного обучения в UV-пространстве высокого разрешения мы предлагаем масштабируемую архитектуру сети, которая чередует свёртки на UV-картах с слоями внимания на облаках точек. Используя эту архитектурную конструкцию, мы обучаем модель диффузии с 700 миллионами параметров, которая может генерировать UV-текстурные карты, руководствуясь текстовыми запросами и изображениями с одного ракурса. После обучения наша модель естественным образом поддерживает различные расширенные приложения, включая текстово-направленное заполнение текстур, заполнение текстур с разреженными видами и синтез текстур, управляемый текстом. Страница проекта доступна по адресу http://cvmi-lab.github.io/TEXGen/.