FitDiT: Прорыв в Виртуальной Примерке с Учетом Деталей и Размеров Одежды

Виртуальная примерка одежды (VTON) становится все более популярной благодаря росту электронной коммерции, предлагая пользователям возможность визуализировать, как будет выглядеть одежда на них, без необходимости физического примерки. Несмотря на значительный прогресс в этой области, существующие методы сталкиваются с рядом проблем, особенно в области сохранения текстуры и точности подгонки по размеру. В этом контексте, FitDiT представляет собой инновационный подход, использующий Diffusion Transformers (DiT) для улучшения качества виртуальной примерки.

Основные Проблемы и Решения

Сохранение Текстуры

Одной из ключевых проблем в виртуальной примерке является сохранение текстуры одежды, включая сложные узоры, текст и полосы. Традиционные методы на основе U-Net часто не уделяют достаточно внимания высокому разрешению латентных признаков, что приводит к потере деталей.

Решение:

- Экстрактор текстуры одежды: FitDiT вводит экстрактор текстуры, который учитывает эволюцию предварительных знаний о текстуре одежды для улучшения детализации.

- Обучение в частотной области: Используется специализированный частотный потерь, чтобы улучшить детализацию высокочастотных элементов одежды.

Подгонка по Размеру

Другая проблема - это подгонка одежды по размеру, особенно при примерке одежды из разных категорий или при несоответствии размеров.

Решение:

- Стратегия расширенного и расслабленного маскирования: FitDiT применяет стратегию маскирования, которая адаптируется к длине одежды, предотвращая заполнение всего маскированного пространства во время примерки.

Архитектура FitDiT

Обзор Модели

FitDiT использует параллельную архитектуру с двумя ветвями:

- GarmentDiT: Экстрактирует детальные признаки одежды из входного изображения.

- DenoisingDiT: Использует эти признаки для генерации изображения примерки с помощью механизма гибридного внимания.

Кастомизация DiT для Виртуальной Примерки

Уменьшение структуры:

- Удаление текстового энкодера для экономии параметров и ускорения обучения и вывода.

Модуляция условий одежды:

- Использование энкодеров изображений для создания эмбеддинга одежды, который модифицирует признаки в блоках DiT.

Инъекция признаков одежды:

- Введение сохраненных признаков одежды из GarmentDiT в DenoisingDiT для улучшения детализации.

Результаты и Преимущества

Качество Изображений

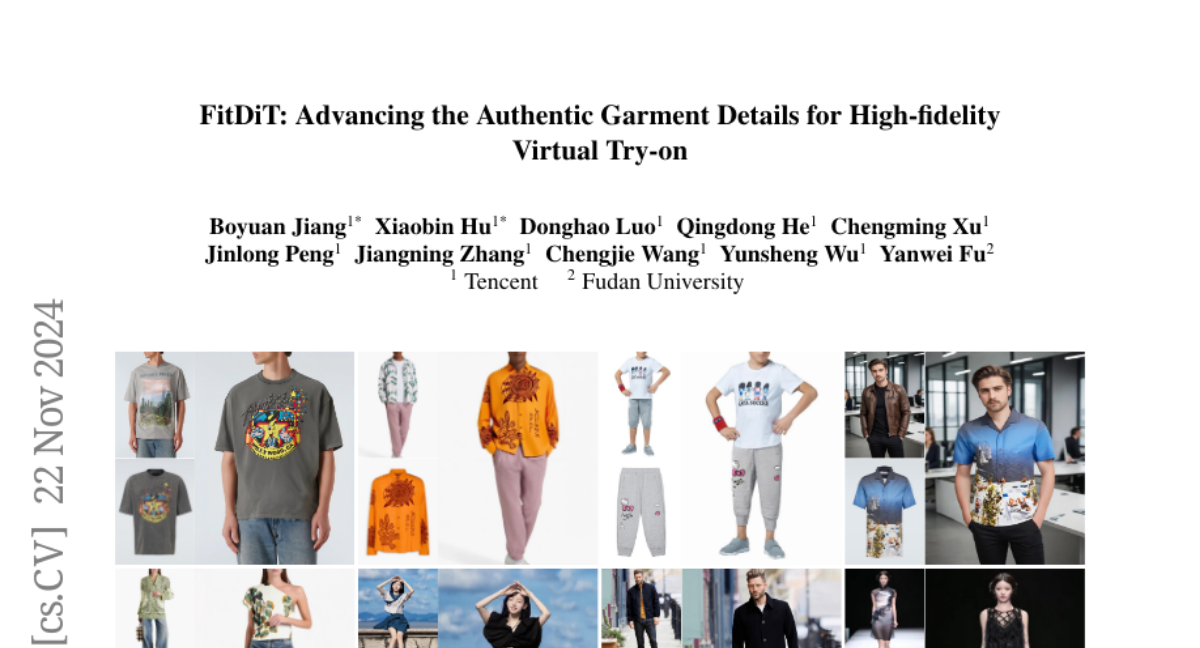

FitDiT превосходит все базовые модели как в качественном, так и в количественном отношении. Он способен генерировать изображения с высокой степенью реализма и точности в деталях одежды.

Скорость Выполнения

После оптимизации структуры, FitDiT достигает конкурентоспособного времени вывода - 4.57 секунды для обработки одного изображения разрешением 1024×768, что делает его более эффективным по сравнению с существующими методами.

Эксперименты и Оценка

Эксперименты проводились на нескольких датасетах, включая VITON-HD и DressCode, а также на специально собранном датасете CVDD, который содержит изображения с сложными текстурами одежды. FitDiT показал превосходные результаты по всем метрикам, включая SSIM, LPIPS, FID и KID.

Заключение

FitDiT представляет собой значительный шаг вперед в области виртуальной примерки одежды, предлагая решения для сохранения текстуры и точной подгонки по размеру. Использование Diffusion Transformers с акцентом на высокое разрешение и специализированные методы обучения позволяет достигать фотореалистичных результатов, что открывает новые возможности для применения виртуальной примерки в реальных условиях.