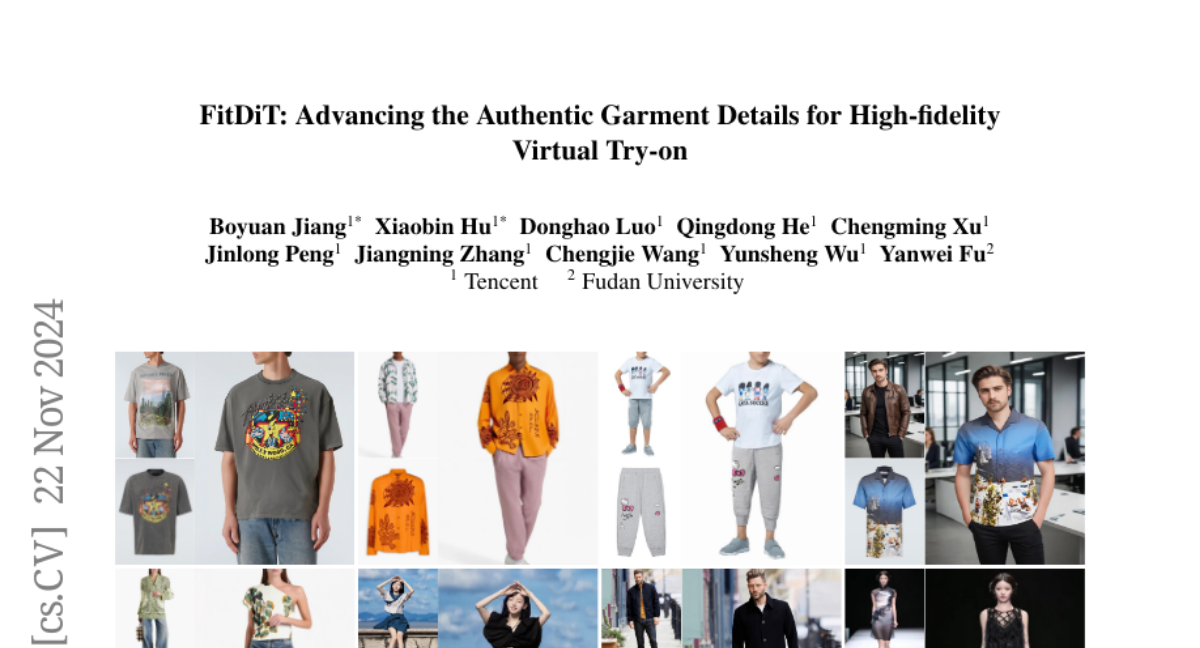

FitDiT: Прорыв в Виртуальной Примерке с Учетом Деталей и Размеров Одежды

Хотя технология виртуальной примерки на основе изображений достигла значительного прогресса, новые подходы все еще сталкиваются с вызовами при создании высококачественных и надежных изображений подгонки в разных сценариях. Эти методы часто испытывают трудности с такими аспектами, как сохранение текстуры и подгонка по размеру, что ограничивает их общую эффективность. Для решения этих проблем мы предлагаем новую технику улучшения восприятия одежды, названную FitDiT, разработанную для высокоточной виртуальной примерки с использованием Diffusion Transformers (DiT), которые выделяют больше параметров и внимания на высокоразрешенные характеристики. Во-первых, для дальнейшего улучшения сохранения текстуры мы вводим экстрактор текстуры одежды, который включает в себя эволюцию приоритетов одежды для тонкой настройки характеристик одежды, что помогает лучше улавливать богатые детали, такие как полоски, узоры и текст. Кроме того, мы вводим обучение в частотной области, настраивая потерю расстояния в частотной области для улучшения деталей одежды с высокой частотой. Для решения проблемы подгонки по размеру мы используем стратегию расширенной-расслабленной маски, которая адаптируется к правильной длине одежды, предотвращая создание одежды, заполняющей всю маскированную область при примерке через категории. Оснащенный вышеуказанным дизайном, FitDiT превосходит все базовые модели как по качественным, так и по количественным оценкам. Он превосходно справляется с созданием хорошо сидящей одежды с фотореалистичными и сложными деталями, при этом достигая конкурентоспособных времен вывода 4.57 секунды для одного изображения 1024x768 после оптимизации структуры DiT, превосходя существующие методы.