Imagine360: Генерация Иммерсивного 360° Видео из Перспективных Анкеров

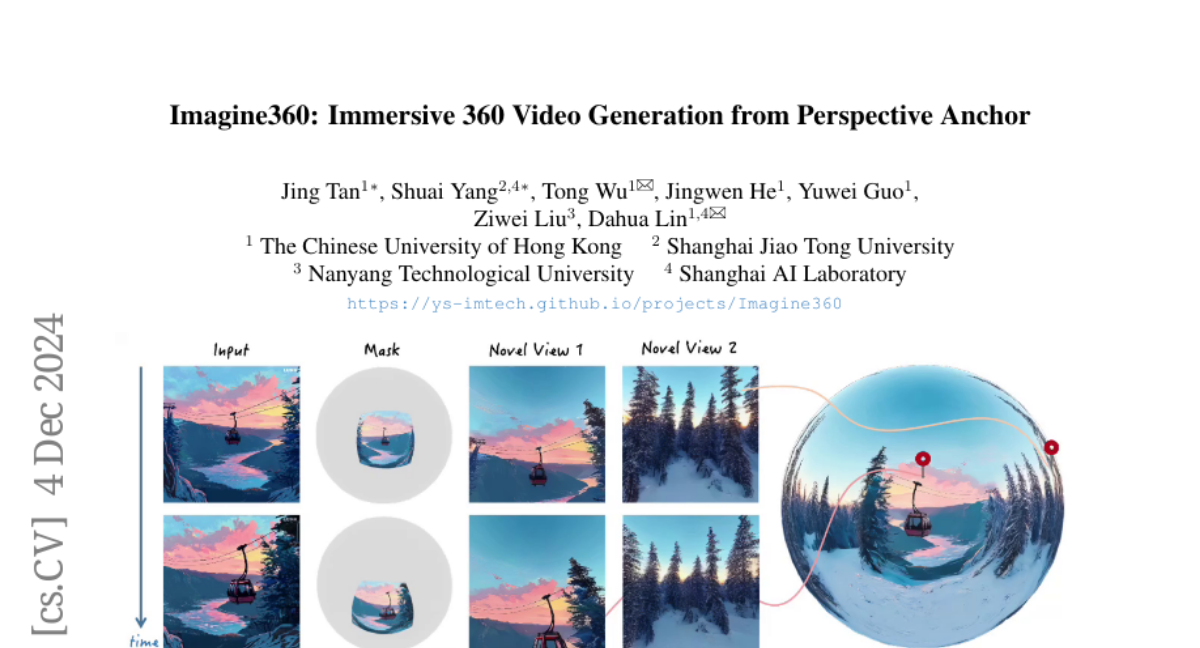

360^circ Видеоролики предлагают гипериммерсивный опыт, который позволяет зрителям исследовать динамическую сцену в полном объеме 360 градусов. Для достижения более удобного для пользователя и персонализированного создания контента в формате 360^circ видео мы стремимся преобразовать стандартные перспективные видео в 360^circ экваториальные видео. С этой целью мы представляем Imagine360, первую платформу для генерации видео, которая преобразует перспективные видео в 360^circ, создавая высококачественные 360^circ видео с богатыми и разнообразными движущимися паттернами из видео- якорей. Imagine360 изучает тонко детализированные сферические визуальные и движущиеся паттерны из ограниченных данных 360^circ видео с несколькими ключевыми разработками. 1) Во-первых, мы принимаем двуветвевый дизайн, который включает в себя ветвь денойзинга перспективного видео и панорамы, чтобы обеспечить локальные и глобальные ограничения для генерации 360^circ видео, с модулем движения и пространственными слоями LoRA, тонко настроенными на расширенных веб-360^circ видео. 2) Кроме того, devised an antipodal mask, чтобы захватить длинные зависимости движения, улучшая превращение камеры между противоположными пикселями на разных полушариях. 3) Чтобы обрабатывать различные входные перспективные видео, мы предлагаем дизайны, учитывающие высоту, которые адаптируются к изменяющимся маскам видео из-за изменения высоты между кадрами. Обширные эксперименты показывают, что Imagine360 достигает превосходного качества графики и согласованности движения среди современных методов генерации 360^circ видео. Мы считаем, что Imagine360 имеет потенциал для продвижения персонализированного, иммерсивного создания 360^circ видео.