Введение в GPT-BERT: Гибридный подход к языковому моделированию

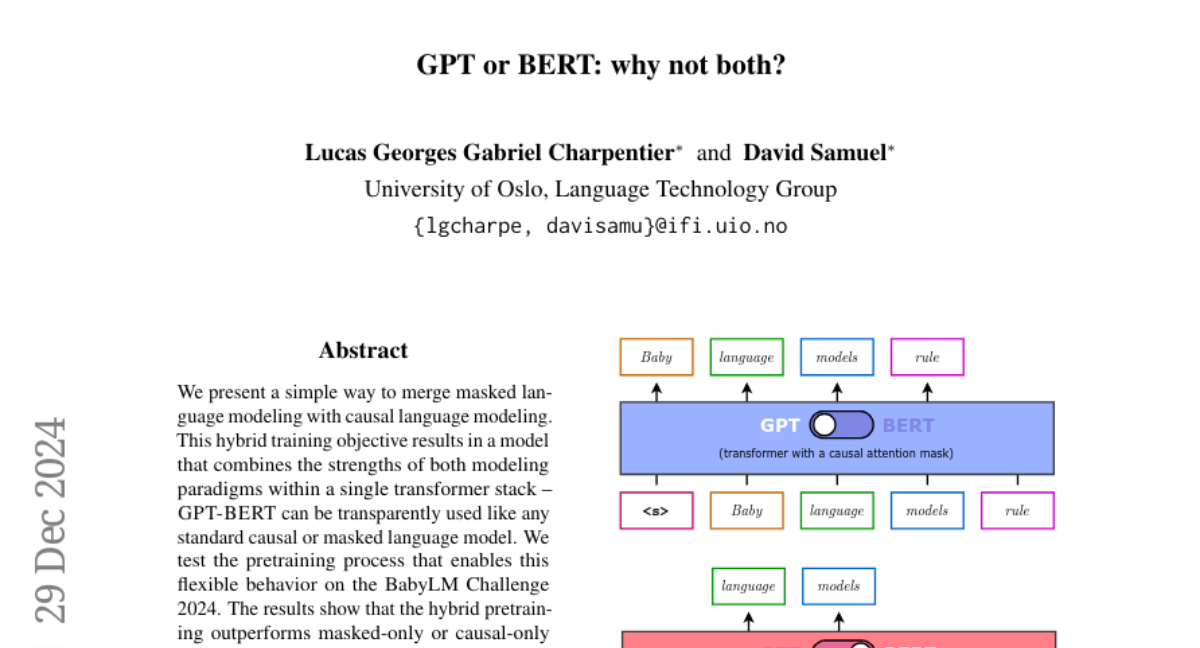

Мы представляем простой способ объединения моделирования языка с маской и причинного моделирования языка. Эта гибридная обучающая цель приводит к созданию модели, которая сочетает в себе сильные стороны обоих парадигм моделирования в едином трансформере: GPT-BERT можно использовать прозрачно, как любую стандартную причинную или модель языка с маской. Мы тестируем процесс предварительного обучения, который обеспечивает такое гибкое поведение, на BabyLM Challenge 2024. Результаты показывают, что гибридное предварительное обучение превосходит модели, использующие только маскированное или только причинное моделирование. Мы открыто публикуем модели, обучающие корпуса и код.