Divot: Диффузионный Токенизатор Видео для Понимания и Генерации

В последние годы наблюдается значительный рост интереса к унификации понимания и генерации изображений с помощью больших языковых моделей (LLMs). Однако, несмотря на успехи в этой области, расширение этой унификации на видео остается относительно недостаточно исследованным. Видео, в отличие от статических изображений, включает в себя как пространственные, так и временные характеристики, что делает задачу более сложной. В данной статье мы рассмотрим концепцию Divot, нового диффузионного токенизатора видео, который объединяет понимание и генерацию видео.

Проблематика

Основная задача, с которой мы сталкиваемся, заключается в разработке универсального видео-токенизатора, который эффективно охватывает сложные аспекты видео данных. Такой токенизатор должен получать надежные видео представления, которые могут служить входом для LLMs, а также декодироваться в реалистичные видеоклипы для генерации. Несмотря на существующие методы, многие из них используют дискретные токенизаторы, что может снижать эффективность в задачах мультимодального понимания.

Концепция Divot

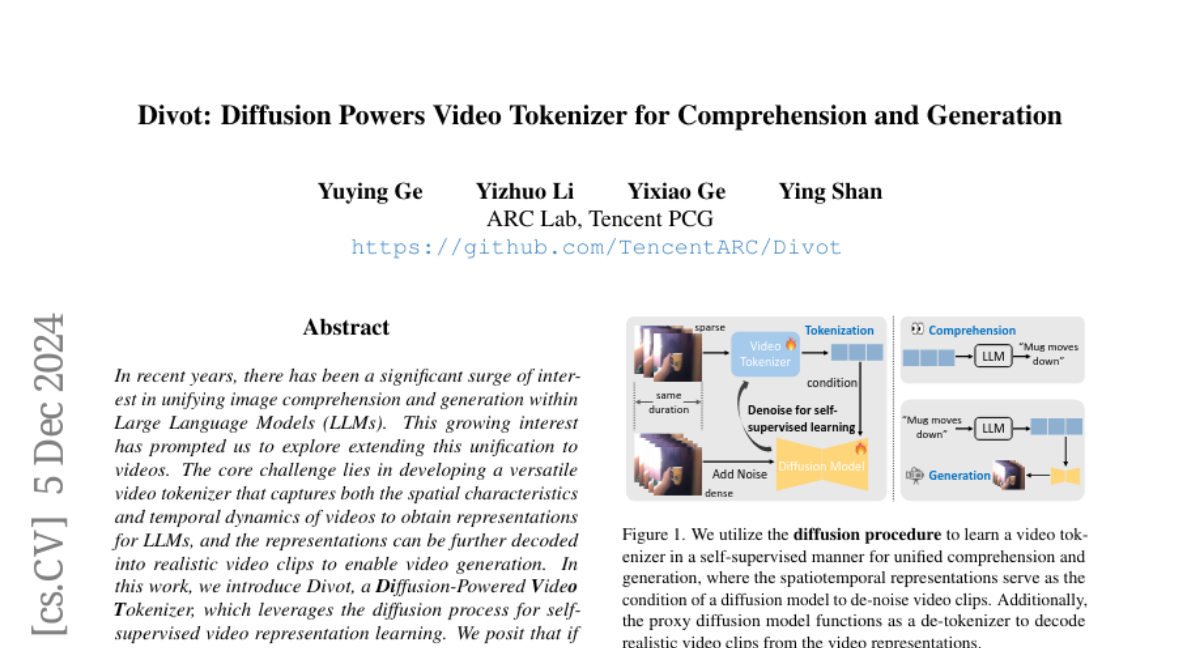

Divot (Diffusion-Powered Video Tokenizer) представляет собой токенизатор, который использует процесс диффузии для обучения представления видео в самоконтролируемом режиме. Основная идея заключается в том, что если диффузионная модель может эффективно предсказать шум, добавленный к латентным представлениям видеоклипов, используя характеристики, полученные от токенизатора, это будет свидетельствовать о том, что токенизатор успешно захватил пространственную и временную информацию, присущую видео данным.

Структура Divot

Токенизатор Divot состоит из предобученного Vision Transformer (ViT) для извлечения признаков на уровне кадров, пространственно-временного трансформера для объединения пространственных и временных данных, а также Perceiver Resampler для формирования фиксированного числа видео токенов. Это позволяет сократить количество токенов, необходимых для генерации, и облегчает процесс обучения LLM.

Процесс Обучения

Подход к Обучению

Обучение токенизатора Divot основано на использовании диффузионной модели, которая обучается на чистых видео данных, таких как WebVid-10M и Panda-70M. В процессе обучения мы отдельно выбираем разреженные кадры для получения пространственно-временных представлений и плотные кадры для получения латентных представлений. Затем в процессе диффузии добавляется гауссов шум, и модель обучается предсказывать этот шум для восстановления оригинальных данных.

Моделирование Представлений Видео

Для генерации видео с использованием LLM с токенизатором Divot необходимо эффективно моделировать непрерывные видео представления. Простой подход, основанный на минимизации расстояния между выходными данными LLM и видео представлениями с использованием ошибки среднеквадратичного отклонения (MSE), оказался неэффективным. Вместо этого мы предлагаем использовать вероятностное моделирование, в частности, модель смеси гауссовых (GMM), чтобы лучше учитывать распределения видео признаков.

Divot-LLM

Divot-LLM объединяет предобученную LLM и токенизатор Divot, чтобы обеспечить понимание и генерацию видео контента в единой структуре. Мы обучаем модель на паре видео-текстов, чтобы она могла выполнять предсказание следующего слова и моделировать распределения видео признаков с помощью GMM.

Обучение и Настройка

Divot-LLM проходит два этапа обучения: многомодальное предобучение и настройка на основе инструкций. На первом этапе модель обучается на видео и текстовых данных, а на втором этапе она настраивается на выполнение конкретных задач, таких как генерация историй на основе видео.

Экспериментальные Результаты

Оценка Понимания Видео

Divot-LLM была протестирована на различных задачах понимания видео, включая многовариантный видеовопрос-ответ. Результаты показали, что модель превосходит существующие модели, которые могут генерировать как текст, так и видео, демонстрируя высокую эффективность в мультимодальном понимании.

Генерация Видео

В рамках нулевой генерации текста в видео Divot-LLM достигла сопоставимых результатов с существующими моделями генерации видео, используя только 4.8 миллиона пар видео-текстов для обучения. Это подчеркивает эффективность токенизатора Divot в захвате пространственно-временных представлений.

Генерация Историй

Divot-LLM также была использована для генерации историй, где модель создает последовательности многомодальных историй с текстом и соответствующими видео, которые временно согласованы. Этот подход демонстрирует универсальность и мощность токенизатора Divot.

Заключение

В данной работе мы представили Divot, диффузионный токенизатор видео, который обучается в самоконтролируемом режиме для унификации понимания и генерации видео. Мы также исследовали эффективные подходы к моделированию непрерывных видео представлений с использованием LLM и представили Divot-LLM, которая достигает конкурентоспособных результатов в задачах понимания и генерации видео.

Divot открывает новые горизонты для дальнейших исследований в области унификации понимания и генерации видео, предоставляя основу для разработки более сложных и эффективных мультимодальных моделей.