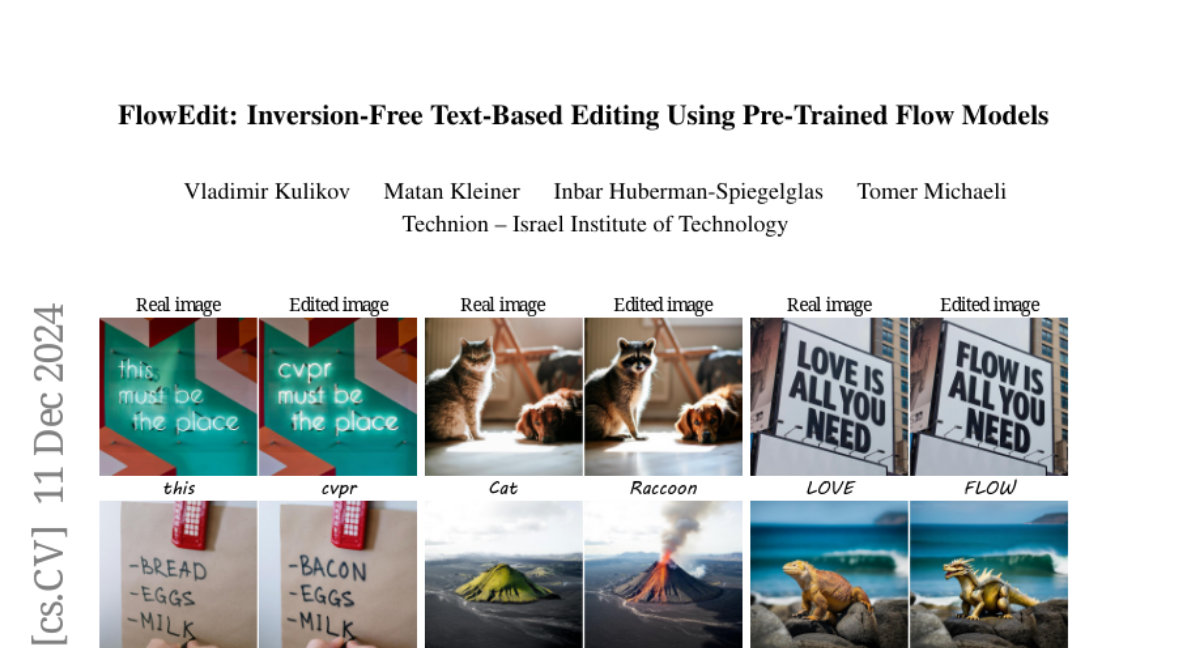

FlowEdit: Новый Подход к Редактированию Изображений на Основе Текста

Редактирование реальных изображений с использованием предварительно обученной модели диффузии/потока текст-в-изображение (T2I) часто включает в себя инвертирование изображения в соответствующую карту шума. Однако только инверсия обычно недостаточна для получения удовлетворительных результатов, и поэтому многие методы дополнительно вмешиваются в процесс выборки. Такие методы достигают улучшенных результатов, но их нельзя бесшовно переносить между архитектурами моделей. Здесь мы представляем FlowEdit, метод редактирования на основе текста для предварительно обученных моделей T2I потока, который не требует инверсии, оптимизации и является независимым от модели. Наш метод строит ОДУ, которая напрямую отображает между исходными и целевыми распределениями (соответствующими исходным и целевым текстовым подсказкам) и достигает более низкой стоимости транспортировки, чем подход инверсии. Это приводит к результатам, соответствующим современным стандартам, как мы иллюстрируем на примере Stable Diffusion 3 и FLUX. Код и примеры доступны на веб-странице проекта.