Улучшение способности следовать сложным инструкциям у больших языковых моделей через обратный перевод ограничений

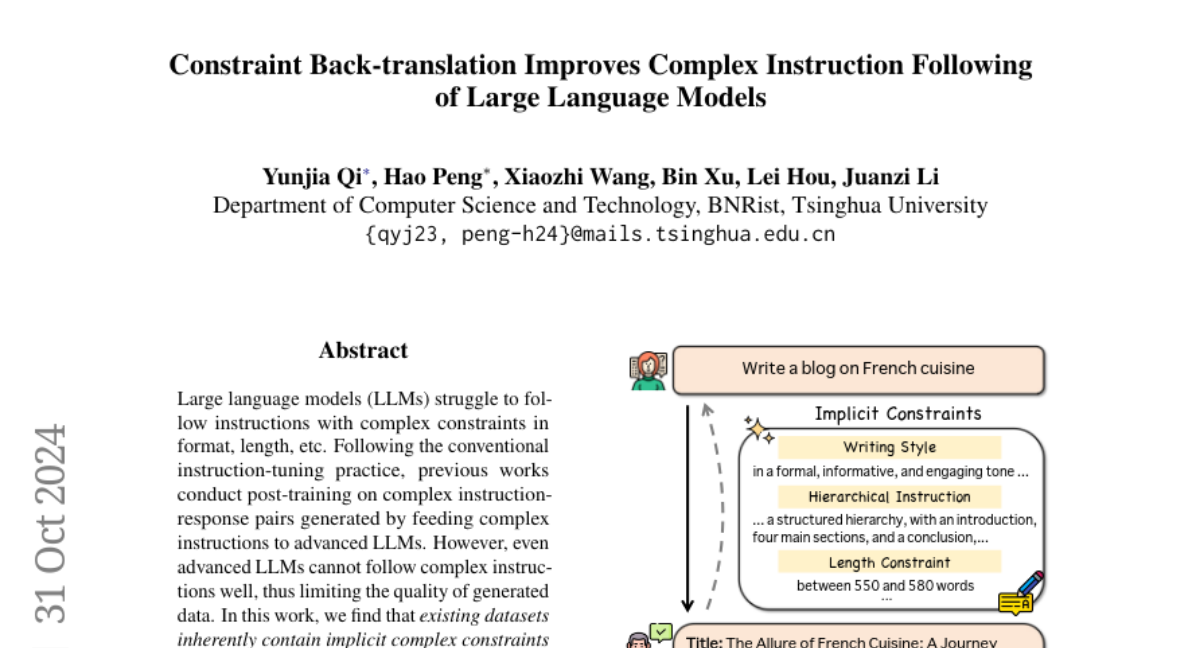

Крупные языковые модели (LLMs) испытывают трудности с выполнением инструкций, содержащих сложные ограничения по формату, длине и т.д. Следуя традиционной практике настройки инструкций, предыдущие исследования проводили постобучение на парах сложных инструкций и ответов, сгенерированных путем подачи сложных инструкций в продвинутые LLM. Однако даже продвинутые LLM плохо справляются с выполнением сложных инструкций, что ограничивает качество генерируемых данных. В данной работе мы обнаруживаем, что существующие наборы данных уже содержат неявные сложные ограничения и предлагаем новый метод генерации данных — обратный перевод ограничений. Конкретно, мы берем высококачественные пары инструкций-ответов из существующих наборов данных и используем только продвинутые LLM для добавления сложных ограничений, которые уже выполняются ответами, что естественным образом снижает затраты и шум данных. В экспериментах мы использовали модель Llama3-70B-Instruct для обратного перевода ограничений и создали высококачественный набор данных сложных инструкций-ответов, названный CRAB. Мы показываем, что постобучение на CRAB улучшает способность различных базовых LLM следовать сложным инструкциям, что было оценено на обширных бенчмарках следования инструкциям. Мы также обнаружили, что обратный перевод ограничений служит полезной вспомогательной целью обучения в процессе постобучения. Наш код, данные и модели будут опубликованы для содействия будущим исследованиям.