Shiksha: Модель и датасет для перевода на индийские языки в технической области

С развитием технологий машинного перевода (Machine Translation, MT) и нейронного машинного перевода (Neural Machine Translation, NMT) появилось множество моделей, способных переводить тексты на различные языки. Однако, несмотря на достижения в этой области, многие модели сталкиваются с трудностями при работе с научными и техническими текстами, особенно когда речь идет о языках с низкими ресурсами, таких как индийские языки. В статье представлено новое решение, которое включает создание многиязычного параллельного корпуса, состоящего из более чем 2.8 миллиона предложений переводов между английским и восемью индийскими языками. Этот корпус был создан на основе транскрипций видео-лекций NPTEL (National Programme on Technology Enhanced Learning), что делает его уникальным и ценным ресурсом для дальнейших исследований в области MT.

Проблемы современного машинного перевода

Современные модели MT часто демонстрируют низкую производительность при переводе технических текстов, что связано с отсутствием специализированных данных для обучения. Например, при переводе фраз с многозначными терминами, такими как "rust" (который может означать как "ржавчина", так и "язык программирования Rust"), модели могут неправильно интерпретировать контекст и выдать неверный перевод. Это подчеркивает важность контекстуального понимания для успешного выполнения задач перевода. Наша работа нацелена на решение этих проблем, предоставляя качественные данные и модели, специально адаптированные для индийских языков.

Создание датасета

Источник данных

Для создания нашего датасета мы использовали транскрипции видео-лекций NPTEL. Это обширная библиотека образовательного контента, содержащая более 56,000 часов лекций по различным дисциплинам. Мы получили список из 10,669 видео и соответствующие транскрипции, которые были предоставлены в двуязычном формате, охватывающем восемь индийских языков: бенгали, гуджарати, хинди, каннада, малаялам, маратхи, тамили и телугу.

Очистка и извлечение данных

Учитывая уникальный формат транскрипций, мы разработали Python-скрипт для извлечения значимого текстового контента, исключая временные метки и другие артефакты. Используя регулярные выражения и инструменты для сегментации текста, мы смогли создать параллельные документы, которые затем были преобразованы в большой битекстовый корпус.

Битекстовый майнинг

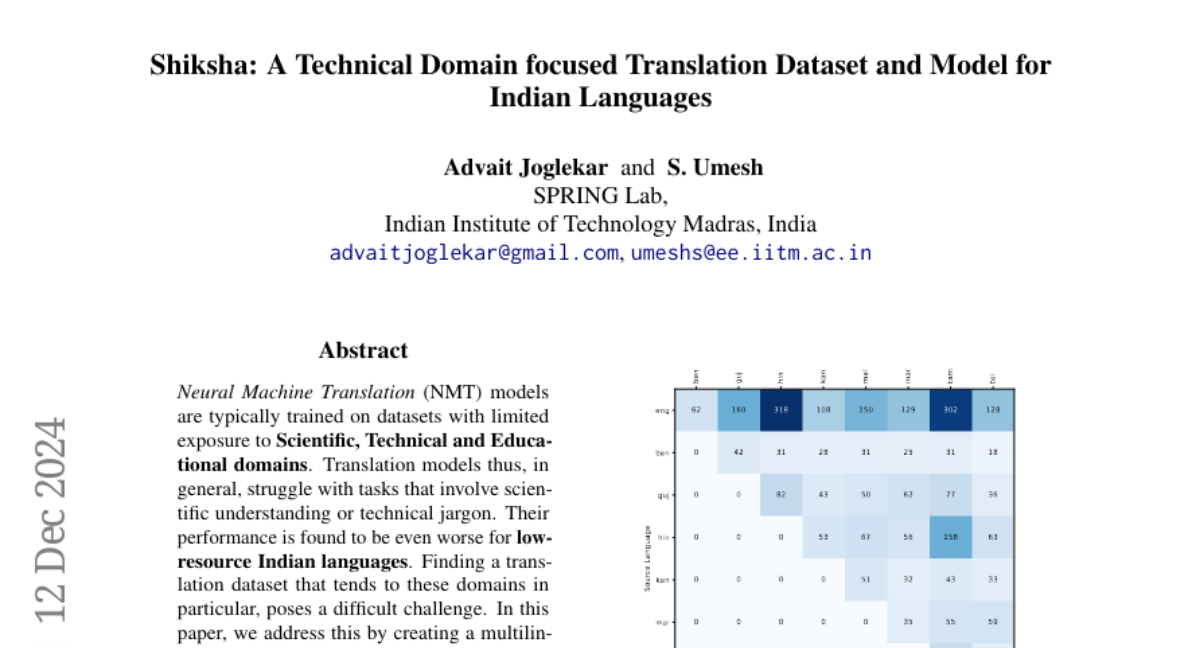

Битекстовый майнинг — это ключевой этап, на котором мы находим как можно больше пар предложений из исходных данных, сохраняя при этом высокую степень уверенности в их точности. Мы использовали современные подходы, такие как алгоритмы на основе многиязычных эмбеддингов, чтобы эффективно находить и сопоставлять предложения. В результате мы собрали около 2.8 миллиона пар предложений, что обеспечивает богатый ресурс для обучения моделей MT.

Модель

Выбор базовой модели

Для дальнейшей работы мы выбрали NLLB-200, мощную многоязычную модель, которая показала высокие результаты на бенчмарке Flores-200 для индийских языков. Мы использовали версию модели с 3.3 миллиарда параметров, которая обеспечивает баланс между качеством и вычислительными требованиями.

Обучение модели

Обучение модели было выполнено с использованием метода адаптации низкого ранга (LoRA), который позволяет эффективно настраивать большие модели без необходимости полного переобучения. Мы провели несколько экспериментов, используя различные подходы к обучению, включая обучение на нашем датасете в одном направлении и комбинированное обучение с использованием других больших корпусов данных.

Оценка модели

Для оценки производительности нашей модели мы использовали как внутренние тесты, так и внешние бенчмарки, такие как Flores+. Результаты показали значительное улучшение по сравнению с базовыми моделями, что подтверждает эффективность нашего подхода. Мы также протестировали модель на различных языках и смогли достичь высоких результатов на технических текстах.

Применение и инструменты

Наши модели интегрированы в инструмент под названием Translingua, который активно используется переводчиками по всей Индии для перевода транскрипций лекций NPTEL на большее количество языков. Этот инструмент позволяет значительно ускорить процесс перевода и повысить его качество.

Заключение

В нашей работе мы представили Shiksha, новый датасет и модель, специально разработанные для индийских языков в научной, технической и образовательной областях. Мы создали обширный многиязычный параллельный корпус, который может служить ценным ресурсом для дальнейших исследований в области машинного перевода. Мы надеемся, что наши результаты вдохновят другие исследования в этой области и помогут улучшить качество перевода для индийских языков.

Ограничения

Несмотря на многообещающие результаты, есть несколько ограничений, которые следует учитывать. Во-первых, наш датасет в значительной степени сосредоточен на научных и технических текстах, что может привести к снижению качества перевода в более общих задачах. Мы рекомендуем дополнить наш датасет более разнообразными источниками, чтобы улучшить его устойчивость и точность в различных контекстах. Кроме того, качество нашего датасета зависит от точности оригинальных транскрипций NPTEL, что также следует учитывать при дальнейших исследованиях.