Mogo: Иерархический Каскадный Трансформер для Генерации 3D Движений Человека

В последние годы генерация 3D движений человека на основе текстовых описаний привлекла значительное внимание в таких областях, как видеоигры, виртуальная и дополненная реальность, анимация и робототехника. Модели, основанные на трансформерах, показали значительные преимущества как в качестве генерации, так и в производительности в реальном времени. В данной статье мы рассмотрим новую архитектуру под названием Mogo, которая сочетает в себе элементы GPT-типичных моделей и улучшенные методы кодирования движений, чтобы достичь выдающегося качества генерации движений.

Архитектура Mogo

Mogo (Motion Only Generate Once) представляет собой модель, способную генерировать высококачественные 3D движения человека, используя единую трансформерную архитектуру. Основные компоненты Mogo включают:

- RVQ-VAE (Residual Vector Quantization Variational Autoencoder) — иерархический автоэнкодер, который дискретизирует непрерывные последовательности движений с высокой точностью.

- Иерархический Каскадный Трансформер — отвечает за генерацию базовых последовательностей движений в авторегрессионном режиме, одновременно выводя остатки на разных уровнях.

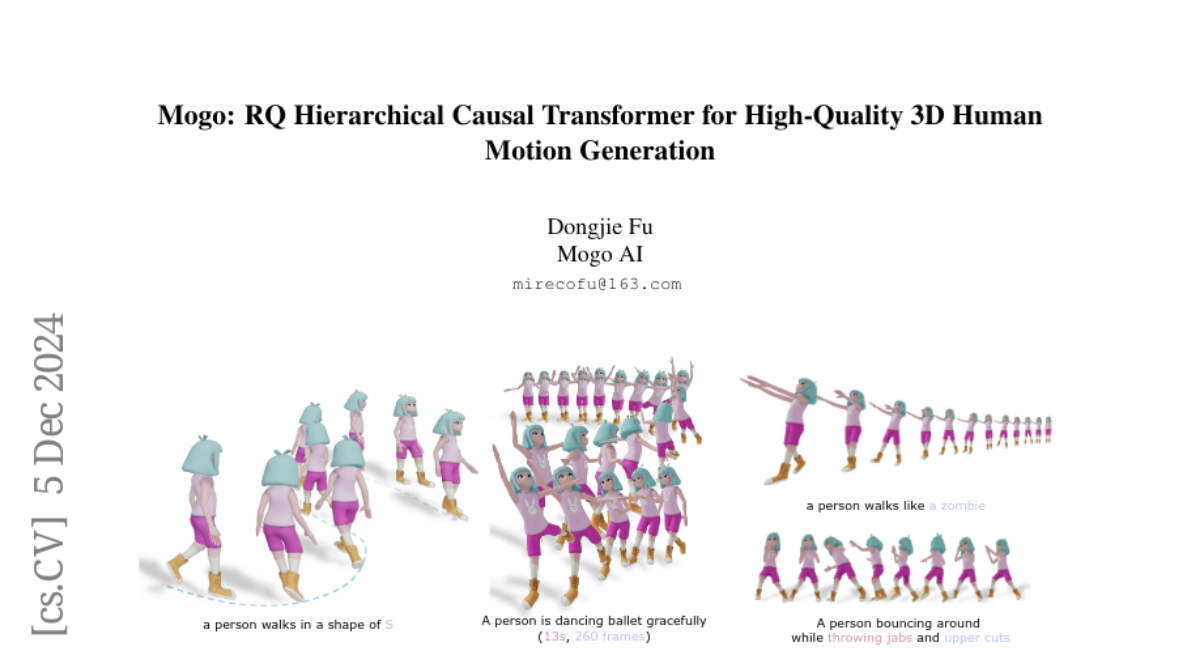

Эта архитектура позволяет Mogo генерировать непрерывные и циклические последовательности движений до 260 кадров (примерно 13 секунд), превосходя существующие ограничения в 196 кадров (10 секунд), установленные в таких наборах данных, как HumanML3D.

Проблемы и Решения

Ограничения Существующих Моделей

Существующие модели, такие как BERT-типичные и GPT-типичные, имеют свои ограничения. BERT-типичные модели, такие как MoMask и MMM, демонстрируют высокое качество генерации, но не могут обеспечивать потоковый вывод, необходимый для приложений в видеоиграх и мультимедийных средах. С другой стороны, GPT-типичные модели, такие как T2M-GPT, имеют проблемы с потерей внимания на длинных последовательностях.

Новые Подходы

Mogo решает эти проблемы, используя единую иерархическую трансформерную модель, что значительно упрощает структуру и уменьшает затраты на обучение. Это также позволяет модели эффективно использовать данные и улучшать качество генерации без необходимости в дополнительных этапах обработки.

Генерация Движений

Mogo генерирует движения на основе текстовых подсказок, таких как "Человек танцует балет грациозно" или "Человек ходит как зомби". При этом модель использует RVQ-VAE для кодирования движений в токены, которые затем обрабатываются иерархическим трансформером.

Процесс Генерации

- Кодирование: RVQ-VAE преобразует непрерывные движения в дискретные токены, сохраняя важные детали.

- Генерация: Иерархический трансформер принимает эти токены и генерирует последовательности движений, учитывая текстовую подсказку.

Экспериментальные Результаты

Экспериментальные результаты показывают, что Mogo достигает значительных успехов в различных метриках, таких как Frechet Inception Distance (FID). На тестовом наборе HumanML3D Mogo достигает FID 0.079, что превосходит результаты других моделей, таких как T2M-GPT (FID 0.116) и AttT2M (FID 0.112).

Сравнение с Другими Моделями

Mogo демонстрирует лучшие результаты в генерации движений, особенно в условиях, когда нужно справляться с данными, которые не были представлены в обучающем наборе. Это подтверждает его способность к обобщению и адаптации к новым типам движений.

Применения и Будущее

Модель Mogo имеет широкий спектр применения, включая создание анимации для видеоигр, симуляции для VR/AR и даже в области робототехники. Возможность генерации длинных и сложных последовательностей движений открывает новые горизонты для разработчиков и исследователей.

Перспективы Развития

Будущее Mogo может включать улучшение алгоритмов для обработки еще более сложных движений, а также интеграцию с другими моделями для мультидисциплинарных приложений. Оптимизация входных подсказок с использованием LLM (Large Language Models) также может повысить производительность генерации в сценариях нулевого и малочисленного обучения.

Заключение

Mogo представляет собой значительный шаг вперед в области генерации 3D движений человека на основе текстовых описаний. Сочетая преимущества GPT-типичных моделей с высококачественным кодированием движений, Mogo достигает выдающегося качества генерации и превосходной способности к обобщению. Это открывает новые возможности для применения в различных областях, от развлечений до робототехники.