Стильные коды: Создание стилизованных изображений с помощью диффузионных моделей

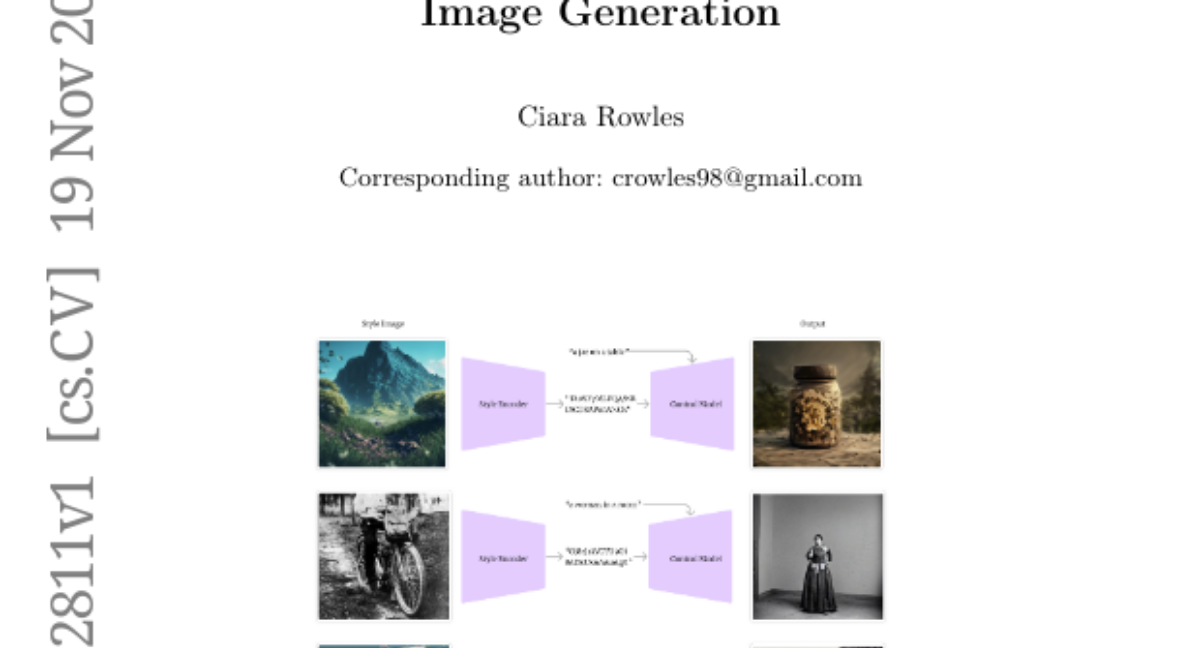

Современные методы генерации изображений с помощью диффузионных моделей (LLM) достигли впечатляющих результатов, но управление этими моделями по-прежнему остается сложной задачей. Одним из ключевых аспектов управления является возможность создания изображений, соответствующих определенному стилю. Хотя использование примеров изображений для стилизации уже является распространенной практикой, это может быть неудобно и не всегда эффективно. В этой статье мы рассмотрим новый подход, который упрощает процесс стилизации изображений — StyleCodes.

Что такое StyleCodes?

StyleCodes — это метод, который кодирует стиль изображения в короткий, 20-символьный код в формате Base64. Этот код может быть использован для условного генерирования изображений, что позволяет легко делиться стилевыми предпочтениями без необходимости передачи исходных изображений.

Преимущества StyleCodes

-

Компактность: Вместо передачи целых изображений, которые могут быть громоздкими, StyleCodes предлагает компактный способ передачи стиля.

-

Совместимость и открытость: В отличие от закрытых решений, таких как srefs от MidJourney, StyleCodes предлагает открытый и доступный для исследований подход, позволяя пользователям генерировать и использовать коды из своих собственных изображений.

-

Минимальная потеря качества: Наши эксперименты показали, что использование StyleCodes приводит к минимальной потере качества по сравнению с традиционными методами стилизации изображений.

Как работает StyleCodes

Архитектура модели

Наша система состоит из нескольких ключевых компонентов:

-

Автоэнкодер: Используется для сжатия изображения в латентное пространство и обратно. Он включает в себя три слоя внимания, которые помогают фокусироваться на стиле изображения, преобразуя его в 20-мерное латентное представление.

-

Декодер: Принимает латентное представление и восстанавливает изображение, учитывая стиль, закодированный в StyleCode.

-

StyleCode-conditioned модель: Это модель, которая использует StyleCode для управления генерацией изображений. Она работает в тандеме с основной UNet моделью, добавляя стилистическую информацию на каждом этапе генерации.

Обучение модели

Обучение модели включает в себя:

-

Генерация данных: Мы использовали комбинацию реальных и синтетических данных, чтобы создать разнообразный набор стилей. Данные были собраны с помощью InstantStyle, применяемого к изображениям из набора данных MidJourney и CommonCanvas.

-

Процесс обучения: Мы использовали замороженную базовую модель Stable Diffusion 1.5, добавляя новые слои для обработки StyleCode. Обучение проводилось с использованием небольших шагов обучения и больших батчей для обеспечения стабильности и качества.

Результаты

Использование StyleCodes позволяет эффективно контролировать стиль генерируемых изображений. Наши эксперименты показали, что:

-

Стилизация: Изображения генерируются с точным соответствием заданному стилю, что подтверждается визуальными примерами.

-

Совместимость: StyleCodes может быть использован с различными вариантами базовой модели без значительного ухудшения качества.

Заключение, ограничения и будущие работы

StyleCodes открывает новые возможности для социального взаимодействия в области генерации изображений, позволяя пользователям легко делиться и использовать стили без необходимости обмена исходными изображениями. Однако есть и ограничения:

-

Стоимость обучения: Для крупных моделей обучение может быть дорогостоящим и требовать значительных вычислительных ресурсов.

-

Предвзятость данных: Использование определенных наборов данных может привести к узкому диапазону стилей в выходных данных.

В будущем мы планируем:

-

Улучшить разнообразие стилей: Использовать более разнообразные и обширные наборы данных для обучения.

-

Интеграция с другими методами: Исследовать возможности интеграции StyleCodes с другими методами управления, такими как LoRA и IPAdapter, для еще большего контроля над генерацией изображений.

StyleCodes представляет собой значительный шаг вперед в области стилизованной генерации изображений, делая процесс более доступным и удобным для широкого круга пользователей.