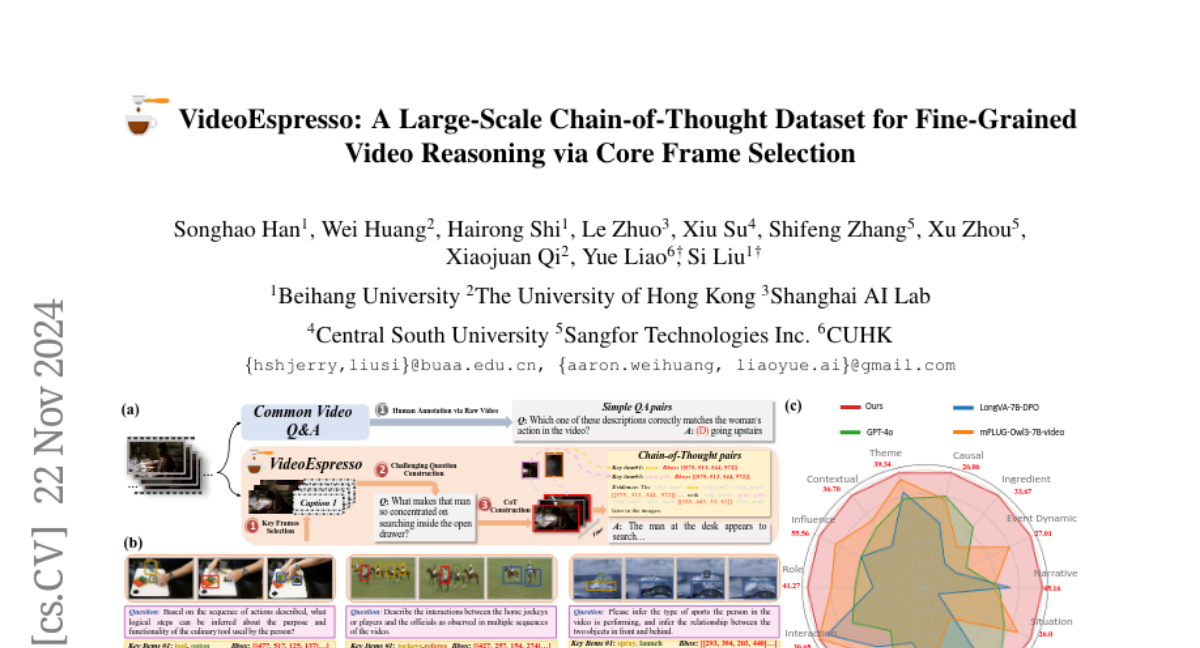

VideoEspresso: Разработка и применение большого набора данных для видеоанализа с использованием цепочки мыслей

Прогресс в области крупномасштабных моделей языков зрения (LVLMs) значительно улучшил понимание мультимодальных данных, однако задачи по рассуждению на основе видео по-прежнему сталкиваются с трудностями из-за недостатка качественных, масштабных датасетов. Существующие наборы данных для вопросно-ответных систем на видео (VideoQA) часто зависят от дорогостоящих ручных аннотаций с недостаточной детализацией или от автоматических методов построения с избыточным анализом кадр за кадром, что ограничивает их масштабируемость и эффективность для сложных рассуждений. Чтобы решить эти проблемы, мы представляем VideoEspresso, новый датасет, который включает пары VideoQA, сохраняющие ключевые пространственные детали и временную последовательность, а также мультимодальные аннотации промежуточных шагов рассуждения. Наша конвейерная линия построения использует метод, ориентированный на семантику, для снижения избыточности, после чего генерируются пары ВО с помощью GPT-4o. Мы также развиваем аннотации видеосвязей мыслей (CoT) для обогащения процессов рассуждения, направляя GPT-4o на извлечение логических связей из пар ВО и содержимого видео. Для использования потенциала высококачественных пар VideoQA, мы предлагаем фреймворк сотрудничества гибридных LVLMs, включающий в себя селектор кадров и двухэтапную инструкцию, настроенную на рассуждения LVLM. Этот фреймворк адаптивно выбирает ключевые кадры и выполняет рассуждения по методу CoT с использованием мультимодальных доказательств. Оцененный на нашем предложенном бенчмарке с 14 задачами против 9 популярных LVLMs, наш метод превосходит существующие базовые модели по большинству задач, демонстрируя превосходные возможности рассуждений по видео. Наш код и датасет будут опубликованы по адресу: https://github.com/hshjerry/VideoEspresso.