FreeScale: Разблокировка разрешения диффузионных моделей с помощью слияния масштабов без настройки

Диффузионные модели произвели революцию в области визуальной генерации, позволяя пользователям без художественного опыта создавать уникальные и персонализированные дизайны, графику и короткометражные фильмы на основе текстовых описаний. Однако существующие визуальные диффузионные модели часто обучаются на данных с ограниченным разрешением, что сдерживает их способность генерировать высококачественные изображения или видео на более высоких разрешениях. В данной статье мы рассмотрим новую методику, названную FreeScale, которая предлагает безнастройочную парадигму вывода для генерации визуального контента с высоким разрешением.

Проблема низкого разрешения

Современные диффузионные модели, такие как Stable Diffusion и VideoCrafter, обычно обучаются на данных с разрешением до 1024x1024 пикселей. Это ограничение связано с нехваткой высококачественных данных и необходимостью значительных вычислительных ресурсов для обработки изображений более высокого разрешения. Хотя некоторые методы пытались решить эту проблему, они часто приводили к повторяющимся паттернам и низкому качеству визуального контента.

Одной из ключевых проблем является увеличение высокочастотной информации, когда модель генерирует визуальный контент, превышающий разрешение, на котором она была обучена. Это приводит к накоплению ошибок и нежелательным повторениям объектов. FreeScale решает эту проблему, предлагая новую стратегию слияния информации из разных масштабов.

Методология FreeScale

Основные компоненты

FreeScale включает несколько ключевых компонентов:

-

Адаптированное самокаскадное увеличение разрешения: Этот компонент постепенно увеличивает разрешение генерируемых изображений, сохраняя при этом их визуальную структуру.

-

Сдержанная дилатированная свертка: Используется для увеличения воспринимаемого поля свертки, что позволяет избежать проблемы повторяющихся объектов.

-

Слияние масштабов: Этот метод объединяет информацию из различных масштабов, чтобы достичь сбалансированного улучшения локальных и глобальных деталей изображения.

Процесс генерации

Процесс генерации начинается с добавления шума к латентному представлению изображения, после чего используется модель для постепенного удаления шума и восстановления изображения. FreeScale использует адаптированное самокаскадное увеличение разрешения для поэтапного улучшения качества изображения, сохраняя при этом его структуру.

Слияние масштабов происходит во время процесса денойзинга, где информация из локальных и глобальных представлений объединяется для достижения более высокой визуальной целостности. Это позволяет избежать проблем с повторением объектов и улучшает качество визуального контента.

Технические детали

FreeScale использует несколько важных техник, таких как:

- Гауссово размытие: Применяется для фильтрации высокочастотной информации и улучшения качества визуализации.

- Селективное извлечение частот: Позволяет извлекать необходимые частотные компоненты для улучшения качества изображения.

Эксперименты и результаты

Настройки экспериментов

Для оценки эффективности FreeScale были проведены эксперименты на предобученных моделях диффузии, таких как SDXL и VideoCrafter2. Генерация изображений проводилась на разрешениях 2048x2048 и 4096x4096 пикселей, а видео на разрешении 640x512.

Результаты генерации изображений

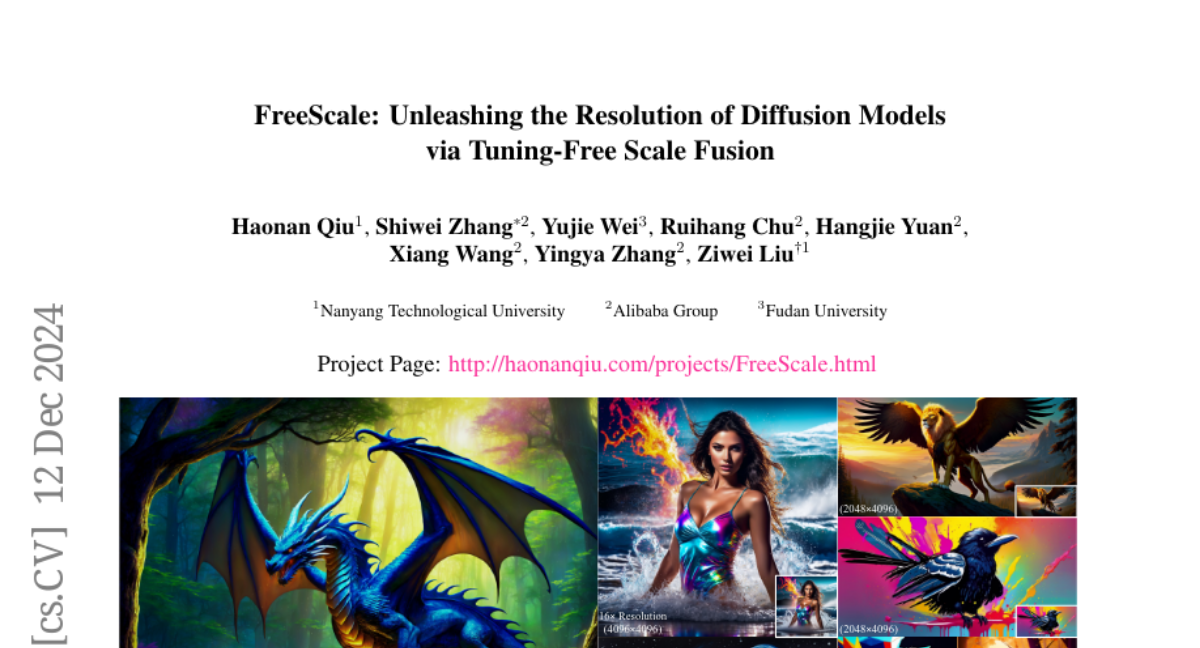

Результаты показали, что FreeScale значительно превышает по качеству предыдущие методы, такие как ScaleCrafter и DemoFusion. Модель FreeScale смогла генерировать изображения с разрешением 8K без потери качества и с минимальными временными затратами на вывод.

Качественные и количественные показатели

Качественные оценки проводились с использованием метрик, таких как FID (Frechet Inception Distance) и KID (Kernel Inception Distance). FreeScale показал лучшие результаты по всем метрикам по сравнению с другими методами, что подтверждает его эффективность в генерации высококачественного визуального контента.

Заключение

FreeScale представляет собой значительный шаг вперед в области генерации визуального контента с высоким разрешением. Используя безнастройочную парадигму вывода, данная методика успешно решает проблемы, связанные с повторением объектов и качеством изображения. FreeScale не только улучшает визуальную целостность и качество изображений, но и открывает новые горизонты для генерации видео с высоким разрешением.

В будущем FreeScale может быть адаптирован для работы с другими архитектурами, такими как DiT, что позволит расширить его использование и повысить качество генерации визуального контента.