Модель POINTS1.5: Прорыв в области моделей "визуальный-язык"

Модели, объединяющие визуальные и языковые данные, достигли значительных успехов в последние годы. Они демонстрируют впечатляющие результаты в таких задачах, как оптическое распознавание символов (OCR) и сложный анализ диаграмм. Однако, несмотря на эти достижения, открытые модели все еще отстают от закрытых коммерческих аналогов, таких как GPT-4o от OpenAI. В ответ на это открытое сообщество разработчиков активно работает над созданием более мощных моделей. Одной из таких моделей является POINTS1.5, которая была разработана для решения реальных задач.

Архитектура модели

POINTS1.5 представляет собой улучшение предыдущей версии POINTS1.0 и включает в себя несколько ключевых нововведений. Основные аспекты архитектуры модели следующие:

-

Замена визуального кодировщика: POINTS1.5 заменяет оригинальный кодировщик CLIP на кодировщик NaViT, который поддерживает динамическое высокое разрешение. Это позволяет модели обрабатывать изображения любого разрешения без необходимости их разбивки на плитки, что значительно улучшает сохранение пространственной структуры изображения.

-

Поддержка двух языков: В новой версии добавлена поддержка китайского языка, что значительно увеличивает возможности модели в этой области. Для этого была собрана большая база данных изображений с аннотациями, выполненными вручную и автоматически.

-

Фильтрация наборов данных для визуального обучения: POINTS1.5 включает в себя строгие методы фильтрации, которые помогают улучшить качество обучающих данных. Это позволяет модели лучше интерпретировать визуальную информацию и следовать инструкциям.

Инновации в POINTS1.5

Динамическое высокое разрешение

Одним из значительных достижений POINTS1.5 является возможность обработки изображений с произвольным разрешением. В отличие от предыдущих моделей, которые могли работать только с изображениями фиксированного разрешения, новая архитектура позволяет избежать необходимости разбивать изображения на плитки. Это не только улучшает производительность, но и снижает вероятность "галлюцинаций" — ошибок в интерпретации модели.

Поддержка китайского языка

POINTS1.5 значительно увеличивает объем данных на китайском языке, что делает модель более универсальной. Для этого была собрана новая база данных, включающая более миллиона изображений с аннотациями. Использование методов, таких как CapFusion и фильтрация по перплексии, позволило создать качественный набор данных для обучения.

Фильтрация наборов данных

В ходе разработки POINTS1.5 были выявлены две основные проблемы в наборах данных, используемых в POINTS1.0: наличие грамматических ошибок и возможность ответов на вопросы без обращения к изображению. Для решения этих проблем была разработана двухступенчатая стратегия фильтрации, которая включает в себя использование больших языковых моделей (LLM) для выявления и исправления ошибок.

Обучение и стратегия модели

Обучение модели POINTS1.5 включает в себя несколько этапов, каждый из которых направлен на улучшение производительности. Важно отметить, что модель обучается с использованием меньшего объема данных по сравнению с аналогичными моделями, что делает ее более доступной.

-

Предварительное обучение: На этом этапе модель обучается на больших объемах данных, чтобы улучшить качество визуального кодировщика и языковой модели.

-

Обучение с инструкциями: На этом этапе модель обучается следовать визуальным инструкциям, что позволяет ей лучше интерпретировать визуальную информацию.

-

Финальное обучение: В этом этапе модель дообучается на отфильтрованных данных, что позволяет улучшить ее общее качество и производительность.

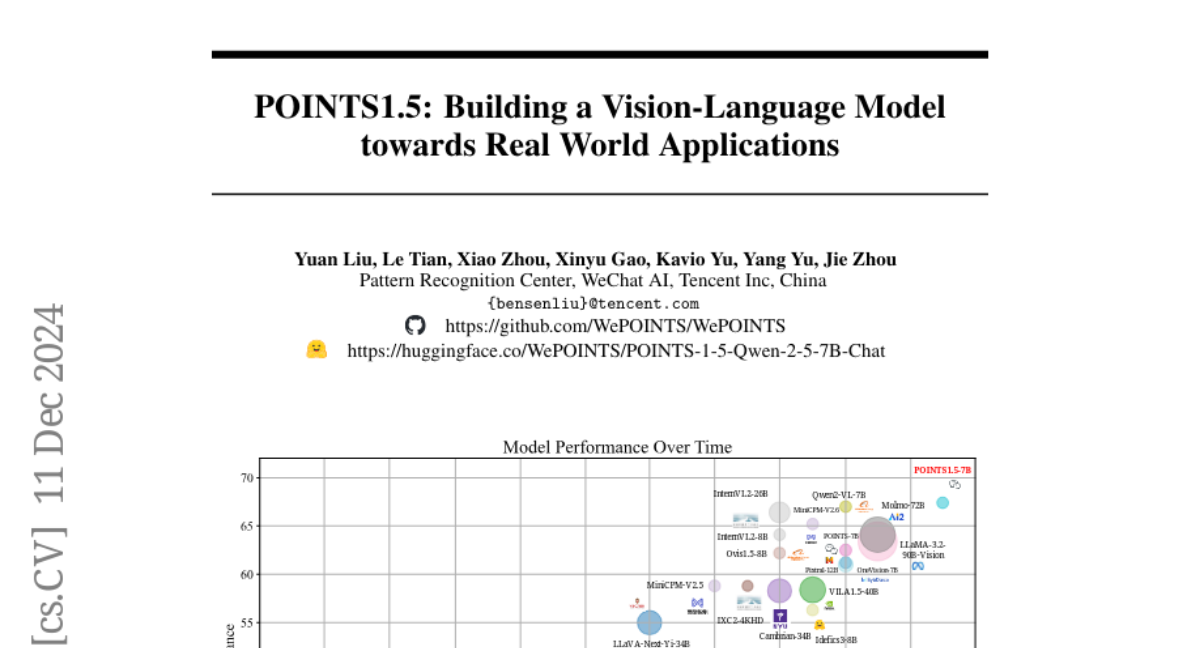

Оценка производительности

POINTS1.5 была оценена по ряду стандартных метрик, включая MMBench, MMMU и другие. Результаты показали, что модель значительно превосходит предыдущие версии и занимает первое место среди моделей с менее чем 10 миллиардами параметров на платформе OpenCompass.

Заключение

POINTS1.5 представляет собой значительный шаг вперед в области моделей "визуальный-язык". Благодаря своим инновациям, таким как поддержка динамического высокого разрешения, двухязычное обучение и строгая фильтрация наборов данных, она демонстрирует впечатляющие результаты в реальных приложениях. Эта модель не только улучшает производительность по сравнению с предыдущими версиями, но и открывает новые возможности для применения в различных областях, таких как OCR, анализ изображений и многое другое.