DiffSensei: Инновации в генерации манги с использованием LLM и диффузионных моделей

Генерация визуальных нарративов из текстовых описаний, известная как визуализация историй, является быстро развивающейся областью. Среди её приложений создание манги занимает особое место из-за своей популярности и уникальных требований к нарративу. В отличие от традиционной визуализации историй, создание манги требует последовательного отображения персонажей, точного контроля компоновки для позиционирования нескольких персонажей и интеграции диалогов в визуально привлекательной форме. Несмотря на успехи в области генерации изображений из текста, существующие модели часто не обеспечивают необходимого контроля над внешним видом и взаимодействиями персонажей, особенно в сценах с несколькими персонажами.

Проблема и задача

Существующие подходы к визуализации историй в основном сосредоточены на низкоуровневых задачах, таких как преобразование изображений в манговый стиль, что не позволяет генерировать полностью кастомизированный контент манги с нуля. Главной проблемой является отсутствие эффективного управления персонажами в динамичных сценах, что и побудило нас предложить новую задачу — генерацию кастомизированной манги. Эта задача включает создание изображений манги с несколькими персонажами, каждый из которых адаптирован в соответствии с текстовыми подсказками и пользовательским вводом.

Решение: DiffSensei

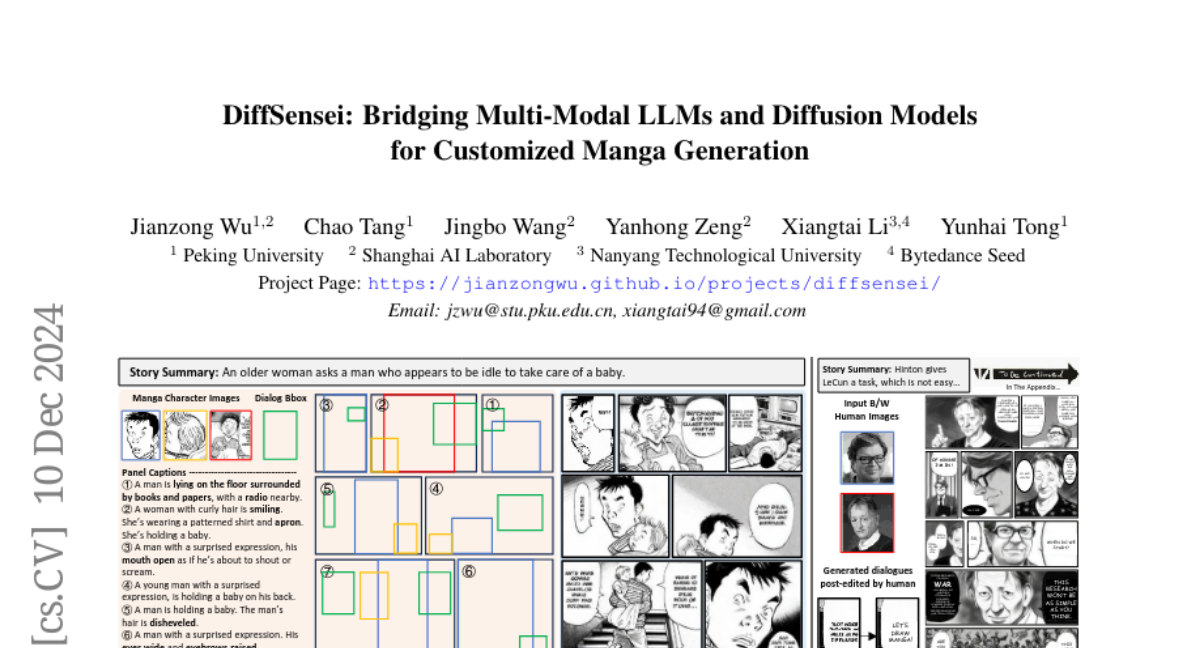

Мы представляем DiffSensei — инновационную архитектуру, предназначенную для генерации манги с динамическим контролем над несколькими персонажами. DiffSensei интегрирует диффузионную модель изображения с мультимодальной большой языковой моделью (MLLM), которая выступает в качестве текстово-совместимого адаптера идентичности. Этот подход позволяет использовать маскированное перекрестное внимание для бесшовного включения характеристик персонажей, обеспечивая точный контроль компоновки без прямой передачи пикселей.

Архитектура DiffSensei

DiffSensei состоит из нескольких ключевых компонентов:

- Генератор изображений на основе диффузии: Основной элемент, отвечающий за создание изображений манги на основе заданных характеристик персонажей и текстовых подсказок.

- MLLM как адаптер характеристик персонажей: Эта модель позволяет динамически изменять состояния персонажей в ответ на текстовые подсказки, что значительно улучшает контроль над выражениями, позами и действиями персонажей.

- Маскированное перекрестное внимание: Этот механизм управляет компоновкой персонажей и диалогов, позволяя точно контролировать их расположение на панелях.

Датасет MangaZero

Для поддержки задачи кастомизированной генерации манги мы собрали новый датасет под названием MangaZero. Этот датасет включает в себя 43 264 страницы манги и 427 147 аннотированных панелей, что позволяет визуализировать разнообразные взаимодействия и движения персонажей в последовательных кадрах. MangaZero стал первым крупномасштабным набором данных, специально разработанным для задачи многоперсонажной, многосостоянийной генерации манги.

Конструкция датасета

Датасет был создан в три этапа:

- Сбор страниц манги: Мы скачали страницы манги из Интернета, выбрав 48 серий и собрав до 1000 страниц на серию.

- Автоматическая аннотация панелей: Мы использовали предварительно обученные модели для автоматической аннотации панелей.

- Человеческая калибровка: Аннотации были дополнительно проверены и скорректированы людьми для повышения точности.

Эксперименты и результаты

Мы провели обширные эксперименты для оценки производительности DiffSensei по сравнению с существующими моделями. Результаты показали, что DiffSensei значительно превосходит другие модели, обеспечивая более высокое качество изображений, согласованность персонажей и контроль над компоновкой.

Метрики оценки

Для оценки качества генерации использовались различные метрики, включая:

- FID (Frechet Inception Distance): Оценка качества сгенерированных изображений.

- CLIP: Сравнение сходства изображений и текста.

- DINO: Оценка сходства изображений персонажей.

Сравнение с базовыми моделями

DiffSensei продемонстрировал превосходство по всем ключевым метрикам по сравнению с моделями, такими как StoryDiffusion, AR-LDM и другими. Особенно выделяется способность DiffSensei к динамическому изменению состояния персонажей в ответ на текстовые подсказки, что ранее было проблематичным для других моделей.

Заключение

DiffSensei представляет собой значительный шаг вперед в области генерации манги, интегрируя диффузионные модели и мультимодальные языковые модели для создания кастомизированного контента. Благодаря инновационным подходам к управлению компоновкой и адаптации характеристик персонажей, DiffSensei способен генерировать выразительные и последовательные панели манги, что открывает новые горизонты в визуализации историй.

В будущем мы планируем продолжить работу над улучшением качества генерации и расширением функциональности модели, а также открытым доступом к коду и датасету для сообщества.