4Real-Video: Новая эра генерации 4D-видео с помощью диффузионных моделей

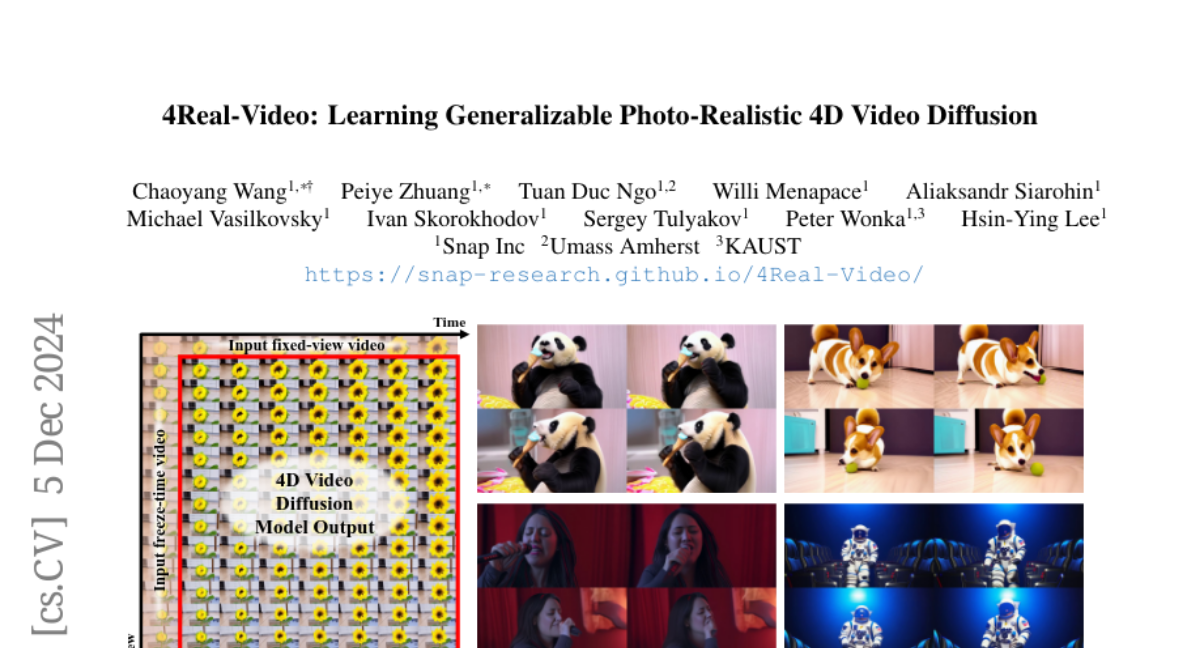

В последние годы наблюдается стремительный рост интереса к генерации видео с использованием диффузионных моделей. В данной статье мы рассмотрим новую архитектуру, предложенную в работе "4Real-Video", которая позволяет генерировать 4D-видео, организованные в виде сетки кадров, где одна ось соответствует времени, а другая — точке зрения. Это открывает новые горизонты для создания динамичных сцен и объектов, а также для улучшения пользовательского опыта в области визуализации и анимации.

Определение 4D-видео

В контексте данной работы 4D-видео определяется как сетка видеокадров, где все кадры в строке имеют одинаковое временное значение, а все кадры в столбце соответствуют одной и той же точке зрения. Это определение отличается от подходов, которые также используют термин "4D-видео" для описания генерации видео с учетом движения камеры. В отличие от этих методов, 4D-видео предоставляет более полное представление о пространственно-временной структуре, что позволяет легче восстанавливать динамичные сцены.

Архитектура 4Real-Video

Двухпоточная архитектура

Ключевым моментом в архитектуре 4Real-Video является использование двух потоков для обработки видеоданных. Один поток отвечает за обновления по точкам зрения, а другой — за временные обновления. Эта параллельная обработка позволяет значительно улучшить скорость вывода и качество визуализации.

Синхронизация потоков

После каждого слоя трансформера в архитектуре происходит синхронизация, которая обеспечивает обмен информацией между двумя потоками. Это позволяет избежать артефактов и улучшить обобщающую способность модели. В работе предлагаются два подхода к синхронизации: жесткая и мягкая синхронизация. Жесткая синхронизация строго соблюдает соответствие между потоками, тогда как мягкая синхронизация позволяет адаптивно изменять взаимодействия токенов.

Эффективность и качество

Модель 4Real-Video демонстрирует высокую скорость генерации и качество визуализации, что подтверждается оценками по метрикам FVD (Frechet Video Distance), CLIP и VideoScore. Она способна генерировать 4D-видео с разрешением 288x512 в течение примерно одной минуты, в то время как предыдущие подходы требовали значительно больше времени.

Обучение модели

Подход к обучению

В процессе обучения модель сначала тренируется на 2D-трансформированных видео, чтобы симулировать синхронизированное движение камеры. Затем происходит дообучение на небольшом наборе данных, состоящем из анимированных объектов из Objaverse. Это позволяет модели эффективно обобщать данные и генерировать качественные 4D-видео даже при ограниченных обучающих данных.

Стратегия маскирования

Для обеспечения гибкости входных конфигураций используется стратегия случайного маскирования. Это позволяет модели предсказывать невидимые кадры на основе любого подмножества входных кадров, что также способствует автогрессивной генерации длинных видео.

Связь с предыдущими работами

Оптимизация на основе генерации 4D

Существующие методы генерации 4D-видео часто требуют длительных процессов оптимизации, что делает их менее эффективными. Модель 4Real-Video предлагает более быстрый и качественный способ генерации видео, что делает её конкурентоспособной по сравнению с другими подходами.

Генерация видео с учетом камеры

Хотя методы генерации видео с учетом камеры продемонстрировали многообещающие результаты, они часто сталкиваются с проблемами многовидовой согласованности. Модель 4Real-Video, напротив, обеспечивает согласованность между различными точками зрения и временными кадрами, что делает её более надежной для создания 4D-видео.

Эксперименты и результаты

Оценка качества

Для оценки качества сгенерированных видео использовались различные метрики, такие как VideoScore, FVD и CLIPScore. Результаты показали, что 4Real-Video превосходит предыдущие методы по всем ключевым показателям, включая визуальное качество и временную согласованность.

Пользовательское исследование

В рамках пользовательского исследования было проведено сравнение с другими методами генерации видео. Участники оценивали различные аспекты, такие как реализм движения, качество переднего и заднего плана, а также общую визуальную привлекательность. Результаты показали, что 4Real-Video значительно опережает конкурентов по всем критериям.

Заключение

4Real-Video представляет собой значительный шаг вперед в области генерации 4D-видео. Используя инновационную двухпоточную архитектуру и эффективные методы синхронизации, модель достигает высокой скорости и качества генерации. Несмотря на достигнутые успехи, в будущем планируется улучшение модели, включая поддержку 360-градусного видео и более сложные динамические сцены.

Таким образом, 4Real-Video открывает новые возможности для создания фотореалистичных 4D-видео, что может значительно улучшить пользовательский опыт в различных областях, включая развлечение, образование и научные исследования.