Mimir: Улучшение моделей диффузии видео для точного понимания текста

Язык — это самый естественный и эффективный способ передачи человеческих идей и перспектив, который развивался на протяжении тысячелетий. В последние годы технологии генерации видео на основе текста (T2V) стали активно развиваться, однако существующие модели диффузии видео, как правило, используют функции из текстовых энкодеров и сталкиваются с ограничениями в понимании текста. Эта проблема побудила исследователей искать способы улучшения семантического восприятия с использованием крупных языковых моделей (LLMs), которые демонстрируют выдающиеся возможности в текстовых задачах.

Проблема

Современные модели T2V, такие как CLIP и T5, хоть и являются мощными, все же не обеспечивают достаточного понимания текста, особенно в контексте генерации видео. Проблема усугубляется тем, что краткие текстовые подсказки не могут охватить все пространственно-временные визуальные детали видео, такие как скорость движущегося автомобиля или изменения фона. Это ограничение побудило исследователей исследовать возможности LLM, которые предлагают три явных преимущества для генерации T2V: точное понимание текста, способность к генерации воображаемого контента и гибкость в приоритизации интересов пользователя.

Решение

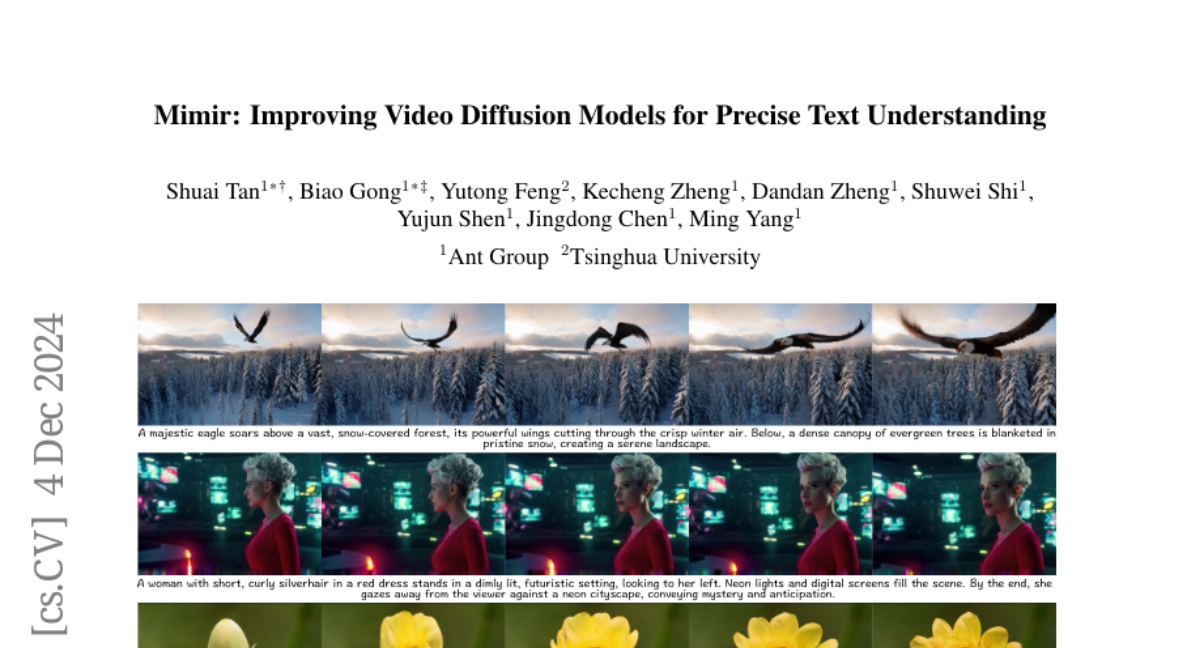

В этой работе мы представляем Mimir — обучающую структуру, которая включает специально разработанный токен-фьюзер для гармонизации выходных данных текстовых энкодеров и LLM. Эта структура позволяет модели T2V полностью использовать обученные видеоприоры, одновременно используя текстовые возможности LLM. Результаты экспериментов показывают, что Mimir значительно улучшает качество генерируемых видео, особенно при обработке коротких заголовков и управлении изменяющимися движениями.

Методология

В этой секции мы сначала представим предварительные сведения о моделях диффузии, затем опишем различные типы токенов и, наконец, введем детали токен-фьюзера, который состоит из двух компонентов: неразрушающего слияния и семантического стабилизатора.

1. Предварительные сведения о моделях диффузии

Для снижения высоких затрат на обучение и вывод при работе с моделями диффузии, большинство из них следуют подходу, известному как латентные модели диффузии. Этот метод обычно включает три ключевых компонента:

- Перцептивная компрессия и декомпрессия видео: Используется предобученный визуальный энкодер для преобразования входного видео в латентное представление, которое затем восстанавливается обратно в пиксельное пространство с помощью визуального декодера.

- Семантическое кодирование: Текстовый энкодер используется для кодирования текстовой подсказки в текстовые функции, которые служат управляющим сигналом для содержания генерируемого видео.

- Модели диффузии в латентном пространстве: Модели диффузии используются для денойзинга нормально распределенного шума, стремясь восстановить реалистичное визуальное содержание.

2. Токены

Для генерации видео мы работаем с двумя типами токенов:

- Видеотокены: Видеофреймы сжимаются в латентное пространство и сегментируются для создания последовательности визуальных токенов.

- Текстовые токены: Используются как текстовые энкодеры для извлечения стабильных токенов на уровне слов из входной подсказки, так и декодеры LLM для извлечения токенов с более богатой семантикой.

3. Токен-фьюзер

Неразрушающее слияние

Токен-фьюзер состоит из двух языковых ветвей (энкодер и декодер) и визуального трансформера. Для устранения несовместимости между токенами мы применяем две эффективные схемы: нормализацию и масштабирование, а также нулевой свертки. Эти шаги обеспечивают согласование масштабов токенов и их интеграцию в процессе обучения.

Семантический стабилизатор

Семантический стабилизатор выполняет две основные функции: он гарантирует, что модель денойзинга точно захватывает основные семантические элементы в подсказке, а также стабилизирует колеблющиеся текстовые функции, возникающие во время предсказания следующего токена.

Эксперименты

В этой секции мы подробно оценим наш метод и предоставим анализ причин, по которым наши улучшения эффективны, а также преимущества нашего подхода в производительности генерации видео.

1. Генерация текста в видео

Мы выбрали Phi-3.5 в качестве декодера LLM и реализовали модели диффузии, следуя установленному графику шума. Мы собрали 500,000 высококачественных видеоклипов для обучения модели Mimir и сравнили наш подход с другими высокоэффективными моделями T2V.

2. Качественная и количественная оценка

Результаты количественной оценки показывают, что Mimir превосходит существующие подходы по всем метрикам. Особенно заметны улучшения в метриках "Множественные объекты" и "Пространственные отношения". Качественные оценки показывают, что Mimir способен точно понимать входные текстовые подсказки, такие как цвет, количество объектов и их взаимное расположение.

3. Пользовательские исследования

Мы провели слепое исследование с участием 10 участников, чтобы оценить качество Mimir и других методов с точки зрения пользователя. Результаты показали, что Mimir превосходит по всем аспектам, включая соблюдение инструкций, физическое моделирование и визуальное качество.

4. Исследования абляции

Для оценки эффективности компонентов Mimir мы провели исследование абляции. Результаты показали, что использование токен-фьюзера и семантического стабилизатора значительно улучшает производительность модели.

Заключение

В данной работе мы представили модель T2V, Mimir, которая использует встраивания крупных языковых моделей в трансформере диффузии видео для достижения точного понимания текста в пространственно-временной семантике видео. Основная инновация нашего подхода заключается в токен-фьюзере, который объединяет семантические функции из энкодеров и декодеров с различными распределениями. Результаты экспериментов и визуализаций подтверждают эффективность Mimir, а обширные количественные и качественные сравнения, наряду с детальным пользовательским исследованием, демонстрируют превосходную производительность нашего метода.