Интерпретация больших мультимодальных моделей: Разбор и управление внутренними представлениями

С недавним развитием больших мультимодальных моделей (LMMs) наблюдается значительный прогресс в области компьютерного зрения и обработки естественного языка. Эти модели применяются в самых различных областях, включая медицинскую диагностику, личные ассистенты и взаимодействие с людьми. Однако, несмотря на их успех, сложная и непрозрачная структура LMMs часто приводит к неожиданным результатам, таким как галлюцинации несуществующих объектов или отношений. Это подчеркивает необходимость понимания и контроля нейронных представлений этих моделей.

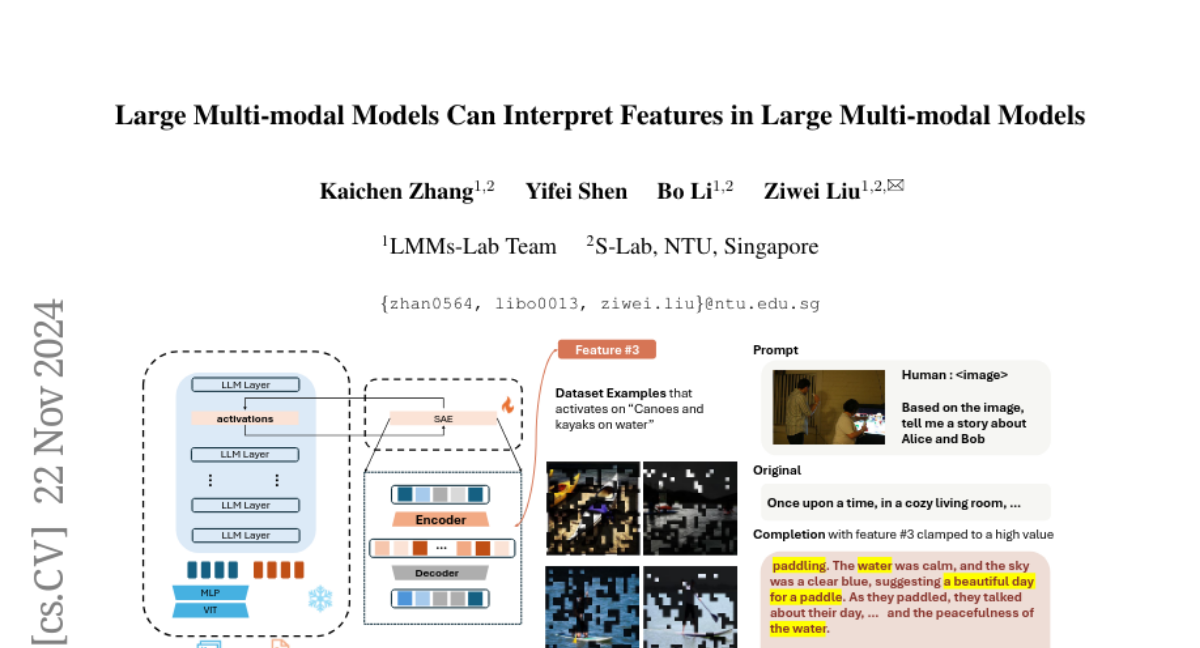

В данной статье рассматривается новый подход к интерпретации мультимодальных моделей, в частности использование разреженных автоэнкодеров (SAE) для выделения и интерпретации семантики внутри LMMs. Мы представим методологию, которая включает в себя автоматическую интерпретацию открытых семантических признаков, изучение эмоциональных характеристик и анализ причин определенного поведения модели.

Методология

1. Разреженные автоэнкодеры (SAE)

Разреженные автоэнкодеры представляют собой мощный инструмент для интерпретации нейронных представлений. Они помогают разъединить многозначные нейроны на более простые, понятные для человека признаки. Архитектура SAE состоит из двух слоев, где используются функции активации Top-K, что позволяет выделять наиболее значимые признаки из входных данных.

Архитектура и функция потерь

Функция потерь комбинирует ошибку реконструкции с дополнительной потерей, предназначенной для предотвращения неактивных признаков. Это позволяет обеспечить, чтобы каждый признак в конечном итоге был моносемантическим, т.е. представлял собой одну конкретную семантику.

2. Автоматическая интерпретация признаков

Для автоматической интерпретации открытых семантических признаков, полученных из SAE, мы разработали специальный пайплайн. Он включает в себя следующие шаги:

- Идентификация активированных изображений: Для каждого признака мы определяем изображения, которые наиболее активно реагируют на него.

- Анализ паттернов: Активированные изображения обрабатываются через LMM, чтобы выявить общие паттерны и сгенерировать объяснения.

3. Управление нейронными представлениями

После интерпретации представлений в SAE мы исследуем, как можно управлять выходом модели, изменяя значения определенных признаков. Это позволяет направлять поведение модели для достижения желаемых результатов.

Эмоциональные признаки в LMMs

Одним из интересных направлений нашего исследования является идентификация эмоциональных признаков в LMMs. Мы выяснили, что LMMs способны не только распознавать эмоции, но и генерировать эмоциональные ответы. Это открывает новые возможности для создания более отзывчивых и человечных систем.

Примеры управления эмоциональными ответами

В ходе экспериментов мы обнаружили, что, изменяя активацию признаков, связанных с эмоциями, можно управлять реакциями модели. Например, при активации признака, связанного с грустью, модель может отвечать с выражением печали, в то время как активация признака счастья приводит к позитивным ответам.

Анализ поведения модели и причины ошибок

Мы также исследовали причины определенного поведения модели и потенциальные источники ошибок, таких как галлюцинации. Для этого мы применили технику, позволяющую локализовать влияние каждого признака на выход модели. Это позволяет не только диагностировать проблемы, но и находить пути их решения.

Пример: Галлюцинации в LMMs

В одном из экспериментов модель неверно ответила на вопрос о географическом положении Боливии. Мы проанализировали, какие признаки активировались и как они влияли на принятие решения. В результате мы смогли установить, что определенные текстовые токены оказывали значительное влияние на вывод модели, даже когда визуальная информация была корректной.

Заключение

Мы представили новый подход к интерпретации и управлению большими мультимодальными моделями, который включает использование разреженных автоэнкодеров для выделения семантических признаков и автоматической интерпретации их значений. Наши результаты показывают, что понимание внутренних механизмов LMMs может значительно улучшить их надежность и предсказуемость. Мы надеемся, что эти находки не только способствуют развитию исследований в этой области, но и стимулируют дальнейшие исследования и инновации в области обработки мультимодальных данных.