Как Чтение Манги Может Помочь Видео-Моделям Понимать Время

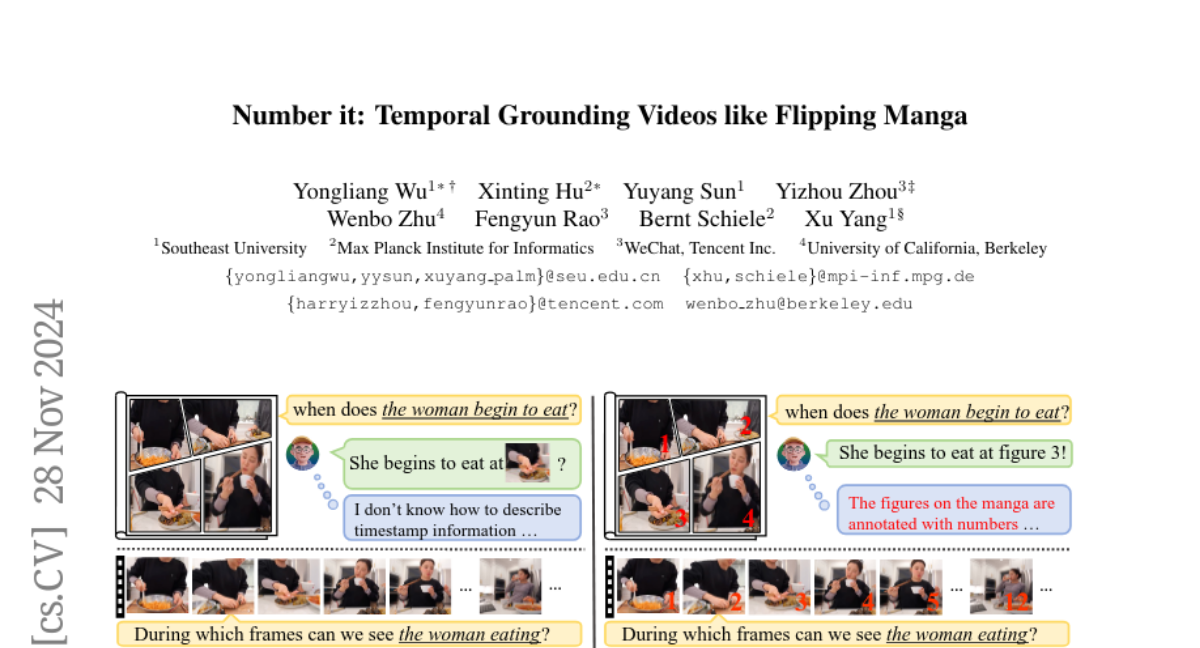

Видео-модели на основе больших языковых моделей (Vid-LLM) достигли значительных успехов в понимании контента видео для задач вопросно-ответного взаимодействия и диалога. Однако, когда дело доходит до точной временной локализации событий в видео, известной как Video Temporal Grounding (VTG), эти модели сталкиваются с серьезными трудностями. В этой статье мы рассмотрим новый подход, названный Number-Prompt (NumPro), который облегчает Vid-LLM понимание временных аспектов видео, используя аналогию с чтением манги.

Представьте себе, что вы смотрите кулинарное видео и пытаетесь найти точный момент, когда шеф-повар добавляет специи. Хотя распознавание таких действий возможно, определение точного времени или номера кадра, когда это происходит, может быть невероятно сложным. Эта проблема является ключевой в области VTG.

Vid-LLM, несмотря на свои достижения в распознавании и понимании видео, часто не могут точно определить, когда событие начинается и заканчивается, что ограничивает их применение в задачах, требующих временной точности.

Чтение Манги как Вдохновение

Чтение манги предоставляет интересный аналог для решения этой проблемы. В манге каждая панель имеет свой номер, что позволяет читателю легко следить за последовательностью событий. Это вдохновило нас на создание метода NumPro, который добавляет уникальные числовые идентификаторы к каждому кадру видео, делая VTG столь же интуитивно понятным, как и чтение манги.

Как Работает NumPro

NumPro преобразует видео в последовательность пронумерованных кадров. Когда модель получает запрос на поиск события, она может использовать эти номера для точного определения временных границ события.

- Нумерация Кадров: Каждый кадр видео снабжается уникальным номером в правом нижнем углу. Это делается с использованием среднего шрифта и яркого цвета, чтобы номера были хорошо видны, но не мешали основному содержанию видео.

- Преимущества: Такой подход позволяет моделям "читать" временную линию видео, связывая визуальное содержимое с конкретными временными метками без необходимости в дополнительном обучении или изменении архитектуры модели.

Эксперименты и Результаты

Дизайн NumPro

Для оптимизации NumPro мы провели исследование, чтобы найти наилучшие параметры для размера шрифта, цвета и позиции номеров:

- Размер Шрифта: Средний размер (40 или 60) оказался оптимальным, обеспечивая хорошую читаемость без значительного ухудшения качества изображения.

- Цвет: Красный цвет показал наилучшие результаты, так как он контрастирует с большинством фонов и легко распознается моделями.

- Позиция: Номера в правом нижнем углу не перекрывают важные элементы видео и легко доступны для восприятия.

Повышение Производительности VTG

Эксперименты показали, что NumPro значительно улучшает производительность VTG:

- Моментное Восстановление: Применение NumPro позволило моделям достигать или превосходить предыдущие результаты, особенно на датасетах Charades-STA и ActivityNet.

- Выделение Высоких Моментов: В задачах выделения ключевых моментов видео, модели с NumPro демонстрировали улучшение на 1.55% в среднем по метрике mAP.

Влияние на Общее Видео-QA

Интеграция NumPro в общие задачи видео-QA показала, что модели сохраняют высокую производительность в понимании контента, одновременно улучшая временное понимание. Это подтверждает, что NumPro не только улучшает VTG, но и не ухудшает общие способности моделей к пониманию видео.

Заключение

NumPro представляет собой инновационный подход, который позволяет Vid-LLM эффективно выполнять задачи временной локализации, используя простую, но мощную аналогию с чтением манги. Этот метод не требует значительных изменений в архитектуре моделей или дополнительного обучения, что делает его универсальным решением для улучшения временного понимания в видео.

NumPro доказывает, что простые визуальные подсказки могут значительно улучшить способность моделей к временному анализу, открывая новые возможности для их применения в интерактивных системах видеоанализа и диалога.