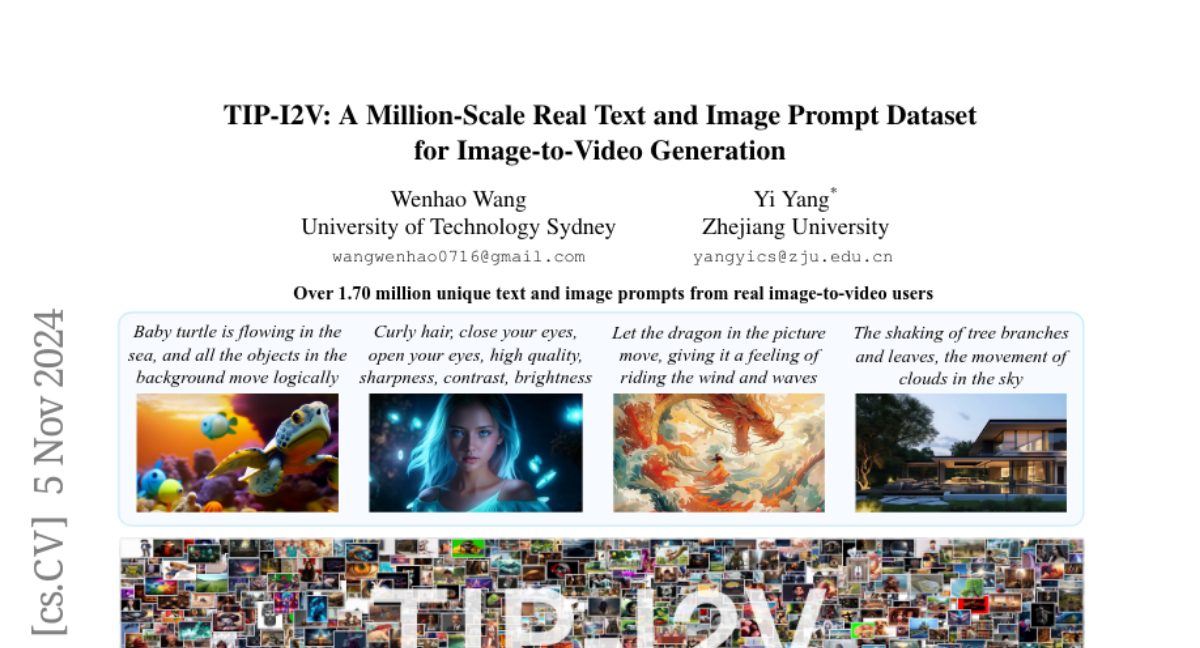

TIP-I2V: A Million-Scale Real Text and Image Prompt Dataset for Image-to-Video Generation

В современной эпохе цифровой трансформации и искусственного интеллекта (AI) создание видео из изображений становится все более востребованным. С появлением моделей, способных преобразовывать статические изображения в динамические видео, перед исследователями и разработчиками открываются новые горизонты. Однако, несмотря на прогресс в этой области, до сих пор отсутствовал специализированный набор данных, который бы фокусировался на пользовательских текстовых и изображенных подсказках для генерации видео. В этом контексте представляется новый датасет TIP-I2V, который является первым в своем роде и содержит более 1.7 миллиона уникальных текстовых и изображенных подсказок, предоставленных реальными пользователями.

Введение в TIP-I2V

TIP-I2V, или Text and Image Prompt Dataset for Image-to-Video Generation, представляет собой уникальный набор данных, который включает в себя не только подсказки, но и соответствующие видеоролики, созданные с помощью пяти передовых моделей генерации видео из изображений: Pika, StableVideoDiffusion, Open-Sora, I2VGen-XL и CogVideoX-5B. Этот датасет позволяет исследователям и разработчикам лучше понимать предпочтения пользователей, оценивать производительность моделей и разрабатывать более безопасные и эффективные системы генерации видео.

Основные компоненты TIP-I2V

- Текстовые и изображенные подсказки: Более 1.7 миллиона уникальных подсказок от реальных пользователей.

- Генерированные видео: Видеоролики, созданные на основе этих подсказок с использованием различных моделей.

- Дополнительные метаданные: UUID, временные метки, встраивания, темы и оценки NSFW (Not Safe For Work) для каждой подсказки.

Сравнение с существующими датасетами

TIP-I2V отличается от других популярных датасетов, таких как VidProM (для текст-видео) и DiffusionDB (для текст-изображение), следующими ключевыми аспектами:

- Основная информация: TIP-I2V начинается с текстовой и изображенной подсказки, в то время как VidProM и DiffusionDB начинаются только с текстовой подсказки.

- Семантическая информация: Текстовые подсказки в TIP-I2V направлены на анимацию статических элементов изображения, в то время как подсказки в других датасетах описывают сцены без привязки к конкретным объектам.

Новые направления исследований с использованием TIP-I2V

Улучшение пользовательского опыта

С помощью TIP-I2V исследователи могут анализировать предпочтения пользователей в отношении объектов и направлений движения, которые они хотят видеть в видео. Это позволяет создавать модели, которые более точно соответствуют ожиданиям пользователей, избегая ненужного расширения обучающих наборов данных.

Более всесторонняя и практичная оценка

TIP-I2V предоставляет возможность для создания более всеобъемлющих и практичных бенчмарков для оценки моделей генерации видео. Это позволяет оценивать не только качество видео, но и его соответствие ожиданиям пользователей, что является критически важным для коммерческого успеха.

Обнаружение сгенерированных видео

Одной из ключевых проблем в области генерации видео является распространение дезинформации. TIP-I2V помогает в разработке методов для идентификации видео, созданных из изображений, что важно для борьбы с фальшивыми новостями и манипуляциями.

Трассировка исходных изображений

Еще одним важным аспектом является способность отследить исходное изображение, из которого было создано видео. Это может помочь в выявлении источников дезинформации и в защите авторских прав.

Заключение

TIP-I2V представляет собой значительный шаг вперед в области генерации видео из изображений. Этот датасет не только предоставляет исследователям богатый материал для анализа и разработки, но и способствует созданию более безопасных, эффективных и удобных для пользователя систем. С его помощью можно не только улучшить качество генерации видео, но и разработать методы для борьбы с негативными социальными последствиями, такими как распространение дезинформации и нарушение авторских прав.

TIP-I2V доступен для исследовательского сообщества, что открывает двери для дальнейших инноваций и исследований в области AI и генерации контента.