Личное биометрическое защитное средство против злонамеренного редактирования изображений

С недавними достижениями в области диффузионных моделей, генеративное редактирование изображений стало более доступным, чем когда-либо. Эти технологии позволяют пользователям легко создавать креативные изменения, однако они также поднимают серьезные этические вопросы, особенно в отношении злонамеренных редактирований портретов людей, которые угрожают безопасности личной жизни и идентичности. Существующие методы защиты изображений в основном сосредоточены на создании адверсариальных искажений, которые призваны нейтрализовать эффекты редактирования. Однако такие подходы часто оказываются нестабильными и неэффективными при защите от разнообразных запросов на редактирование.

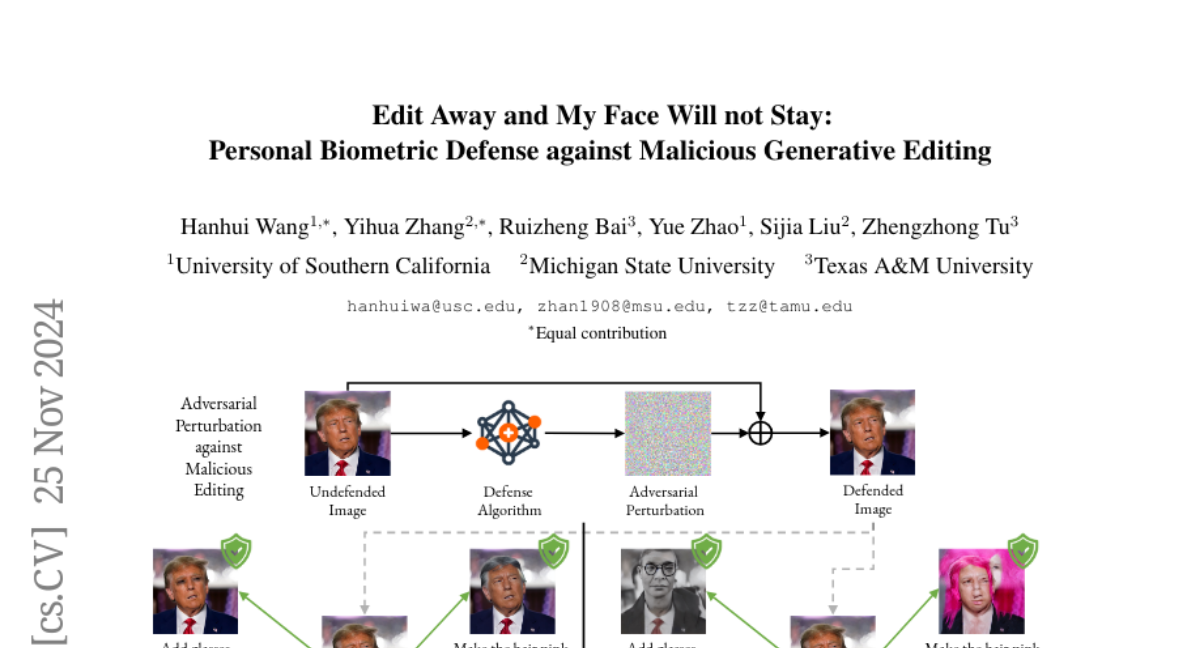

В данной статье мы представляем новый подход к защите личных портретов от злонамеренного редактирования, который мы называем F,ACE,L,OCK. В отличие от традиционных методов, которые стремятся предотвратить применение редактирования, наш метод оптимизирует адверсариальные искажения, чтобы гарантировать, что оригинальная биометрическая информация (например, черты лица) будет либо уничтожена, либо существенно изменена после редактирования. Это делает изображение биометрически неузнаваемым, независимо от конкретных запросов на редактирование.

Проблема злонамеренного редактирования

С ростом возможностей генеративного редактирования изображений возникли серьезные этические проблемы. Недавние инциденты, такие как манипуляции изображениями известных личностей и распространение порнографического контента, подчеркивают необходимость защиты личных изображений от несанкционированных и злонамеренных изменений. Защита таких изображений от злонамеренных редактирований становится важной задачей для исследователей и разработчиков.

Существующие методы защиты, такие как PhotoGuard и EditShield, используют адверсариальные искажения, которые невидимы для человеческого глаза, однако они часто оказываются неэффективными против разнообразных стилей редактирования. Это связано с тем, что многие из этих методов сосредоточены на "отмене" эффектов редактирования, что приводит к нестабильности результатов.

Новый подход: F,ACE,L,OCK

Основные принципы

Метод F,ACE,L,OCK предлагает новый взгляд на защиту личных изображений. Вместо того чтобы пытаться отменить редактирование, мы задаем вопрос: "Можем ли мы создать адверсариальные искажения, которые сделают редактируемые изображения биометрически неузнаваемыми?" Это позволяет нам защитить личные изображения, разрушая биометрическую информацию, что приводит к неудаче редактирования.

Архитектура метода

Метод F,ACE,L,OCK интегрирует современные модели распознавания лиц в процесс оптимизации искажений. Мы используем модель, которая оценивает сходство между чертами лица до и после редактирования, и на основе этой оценки создаем адверсариальные искажения. Таким образом, мы не только нарушаем распознавание лиц, но и обеспечиваем значительные визуальные различия между оригинальным и редактированным изображениями.

Этапы работы метода

- Инициализация искажений: Начинаем с инициализации адверсариального искажения, которое будет применяться к исходному изображению.

- Оптимизация искажений: Используем модель распознавания лиц для оценки искажения. Мы стремимся максимизировать различия между чертами лица в исходном и редактированном изображениях.

- Обработка редактирования: Применяем искажения к изображению и передаем его в модель редактирования, которая создает новое изображение на основе заданной инструкции.

- Оценка результатов: Оцениваем эффективность защиты, сравнивая сходство между оригинальным и редактированным изображениями.

Эффективность и результаты

В ходе экспериментов мы показали, что F,ACE,L,OCK значительно превосходит существующие методы защиты. Мы провели обширные тесты, используя набор изображений, включающий разнообразные расы, возраст и пол, чтобы оценить эффективность защиты в различных сценариях редактирования.

Оценка защиты

Мы использовали несколько метрик для оценки защиты, включая:

- Сходство лиц: Оценка сходства между чертами лица в защищенном и редактированном изображениях.

- Оценка качества изображений: Использование метрик PSNR и SSIM для оценки визуального качества изображений.

- Перцептивная оценка: Применение метрики LPIPS для оценки различий на семантическом уровне.

Результаты показали, что наш метод не только эффективно разрушает биометрическую информацию, но и сохраняет высокое качество изображений, что делает его идеальным для применения в реальных сценариях.

Сравнение с другими методами

В сравнении с PhotoGuard и EditShield, F,ACE,L,OCK показал более высокую эффективность в защите лиц от злонамеренных редактирований. В частности, наш метод продемонстрировал лучшую устойчивость к очистительным техникам, что делает его более надежным для защиты изображений.

Критический анализ существующих метрик

Мы также провели критический анализ существующих количественных метрик, используемых для оценки редактирования изображений. Мы выявили несколько недостатков в популярных метриках, таких как CLIP, SSIM и PSNR, которые могут быть легко манипулированы для достижения обманчиво высоких оценок.

Проблемы существующих метрик

- CLIP-метрики: Слишком акцентируют внимание на наличии элементов из редактирования, что может привести к переоценке редактирований, которые на самом деле искажают идентичность.

- SSIM и PSNR: Эти метрики могут вводить в заблуждение, поскольку не учитывают сложность редактирования и разнообразие возможных результатов.

Новые метрики

Мы предлагаем использовать метрику LPIPS для более надежной оценки перцептивных различий между изображениями, что позволяет лучше оценить эффективность защиты.

Заключение

Метод F,ACE,L,OCK представляет собой значительный шаг вперед в области защиты личных изображений от злонамеренного редактирования. Он эффективно разрушает биометрическую информацию, сохраняя при этом высокое качество изображений. Наша работа не только улучшает существующие методы защиты, но и поднимает важные вопросы о личной безопасности и этике в эпоху генеративного ИИ.

Перспективы будущих исследований

Будущие исследования могут сосредоточиться на расширении применения F,ACE,L,OCK для изображений с несколькими людьми, а также на адаптации метода к новым генеративным моделям. Это поможет улучшить защиту личной информации в условиях быстрого развития технологий редактирования изображений.