Контролируемая генерация человеческих изображений с персонализированными мульти-гарментами

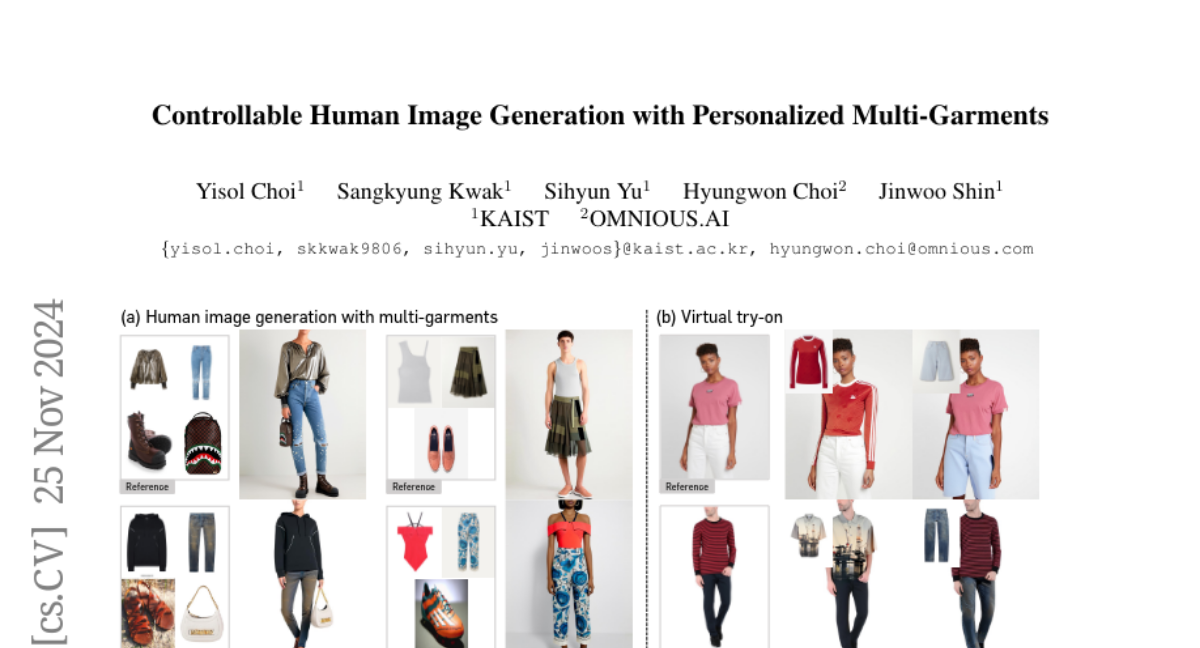

В последние годы текст-к-изображению (T2I) диффузионные модели продемонстрировали впечатляющие результаты в различных задачах, от персонализированной генерации до стилизации и редактирования изображений. Однако, несмотря на эти достижения, создание высококачественных изображений человека, одетого в несколько предметов одежды, остается сложной задачей. В этом контексте, исследователи из KAIST и OMNIOUS.AI представили новую рамку под названием BootComp, которая значительно улучшает контролируемую генерацию изображений человека с использованием множественных референций одежды.

Введение в BootComp

BootComp предлагает новый подход к решению основной проблемы в обучении моделей генерации человеческих изображений — нехватка качественных данных. Сбор большого объема данных, где каждый человек одет в несколько различных предметов одежды, является трудоемким и дорогостоящим процессом. BootComp решает эту проблему через:

-

Генерацию синтетических данных: Создание большого синтетического набора данных, состоящего из изображений людей и нескольких предметов одежды, используя модель для извлечения референций одежды из каждого изображения человека.

-

Фильтрацию данных: Улучшение качества данных путем удаления нежелательных сгенерированных образцов, основываясь на измерении перцептивных сходств между одеждой на изображении человека и извлеченной одеждой.

-

Обучение композиционного модуля: Использование созданного синтетического набора данных для обучения диффузионной модели, которая имеет два параллельных пути деноизинга, использующих изображения одежды в качестве условий для генерации изображений человека с сохранением деталей.

Основные компоненты BootComp

Модуль декомпозиции

Этот модуль отвечает за извлечение изображений одежды из изображений людей. Он обучается на данных, где каждое изображение человека сопровождается одним референционным изображением одежды. Модуль использует предобученные текст-к-изображению диффузионные модели и адаптирует их для извлечения одежды, учитывая категорию одежды, указанную в текстовом запросе.

Синтетическая генерация данных

После обучения модуль декомпозиции используется для создания синтетических данных, где каждое изображение человека сопровождается несколькими изображениями одежды. Это позволяет создать набор данных, который можно использовать для обучения модели генерации изображений с множественными условиями.

Фильтрация данных

Для обеспечения высокого качества данных, BootComp применяет стратегию фильтрации, измеряя перцептивное сходство между сегментированными изображениями одежды и сгенерированными изображениями одежды. Используется метрика DreamSim, которая хорошо коррелирует с человеческим восприятием.

Композиционный модуль

Этот модуль включает в себя два диффузионных модели: одну для генерации изображений, другую для кодирования изображений одежды. Модель генерации остается замороженной, а модель кодирования обучается на синтетических данных для обеспечения условий генерации изображений человека с учетом всех предметов одежды.

Применение и результаты

BootComp демонстрирует широкую применимость, позволяя генерировать изображения людей в различных позах, стилях (например, мультяшные) и с персонализированными условиями (например, лицо пользователя). Результаты экспериментов показывают, что BootComp превосходит существующие методы по метрикам качества изображений, таких как FID (Frechet Inception Distance) и MP-LPIPS (Multi-Patch LPIPS), что подчеркивает его способность сохранять детали одежды и создавать реалистичные изображения.

Заключение

BootComp предлагает инновационный подход к генерации изображений человека, решая проблему сбора данных через синтетическую генерацию и фильтрацию. Это открывает новые возможности для применения в различных областях, от моды до виртуальных примерок и персонализированной генерации изображений.

Таким образом, BootComp не только улучшает качество генерации изображений, но и делает этот процесс более доступным и адаптируемым к различным условиям и требованиям пользователей.