FINE CAPTION: Композиционное описание изображений с фокусом на любую область с любой детализацией

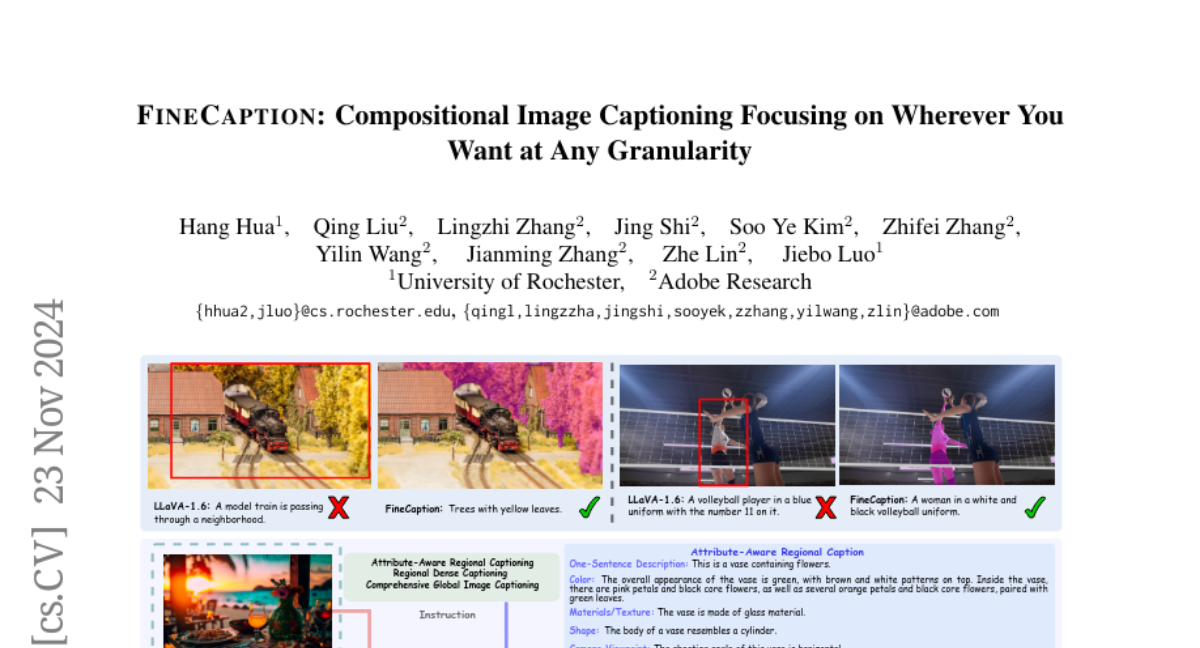

В мире, где визуальная информация становится всё более важной, задача создания точных и информативных описаний изображений приобретает особое значение. С развитием крупных языковых моделей (LLM) и искусственного интеллекта (AI), появляются новые возможности для улучшения взаимодействия между человеком и машиной. В данной статье мы рассмотрим FINE CAPTION, инновационную модель Vision-Language, которая предлагает новый подход к описанию изображений, фокусируясь на детализации и композиционности.

Представьте, что вы смотрите на картину, где каждая деталь имеет своё значение, каждый объект взаимодействует с другими, создавая сложную визуальную сцену. Теперь представьте, что вы хотите описать эту сцену, но не просто перечислить объекты, а передать их взаимосвязь, атрибуты и контекст. Именно здесь вступает в игру FINE CAPTION, разработанная для того, чтобы сделать процесс описания изображений более точным и информативным.

Основные концепции FINE CAPTION

FINE CAPTION предлагает три ключевых направления в описании изображений:

-

Attribute-Aware Regional Captioning (AARC) - Описание атрибутов конкретных областей изображения.

-

Regional Dense Captioning (RDC) - Создание плотных описаний для множества областей на изображении.

-

Comprehensive Global Image Captioning (CGIC) - Глобальное описание всего изображения, учитывая все его компоненты.

Attribute-Aware Regional Captioning (AARC)

Эта функция позволяет модели фокусироваться на определённых областях изображения, описывая их с учётом атрибутов, таких как цвет, текстура, материал, форма и взаимодействие с другими объектами. Например, если мы рассматриваем изображение с вазой, FINE CAPTION может не только определить, что это ваза, но и описать её цвет, узор, материал, форму и даже её положение относительно других объектов на столе.

Regional Dense Captioning (RDC)

RDC идёт дальше, предоставляя множество детализированных описаний для различных областей изображения. Это позволяет создать более полное и богатое описание, охватывающее все значимые элементы сцены. Например, на пляжной сцене с закатом, модель может описать не только общую атмосферу, но и каждый объект отдельно: стол, вазу, цветы, их тени, стаканы, фрукты и т.д.

Comprehensive Global Image Captioning (CGIC)

CGIC объединяет все элементы в одно целое, создавая описание, которое охватывает всю сцену, её атмосферу, эмоции и общую композицию. Это может быть что-то вроде: "На закатном пляже, деревянный стол украшен зелёной вазой с узорами, содержащей цветы с оранжевыми и розовыми лепестками. Вокруг расположены стаканы с напитками, фрукты и тарелка с едой, создавая гармоничную тропическую обстановку для ужина."

Технические аспекты FINE CAPTION

FINE CAPTION использует комбинацию из низкоразрешённых и высокоразрешённых энкодеров для обработки изображений.

-

Mask-Aware Encoding - Модель способна распознавать произвольные маски как референции, что позволяет точно описывать интересующие области.

-

High-Resolution Encoding - Для захвата детализированной информации используются высокоразрешённые энкодеры, такие как ConvNeXT и SAM, поддерживающие разрешение до 1024x1024 пикселей.

-

Feature Fusion - Объединение признаков из разных энкодеров для создания богатого представления изображения.

-

Integration with LLM - Использование адаптера для интеграции визуальных признаков в пространство эмбеддингов языковой модели.

Данные и обучение

Для обучения и оценки FINE CAPTION был создан новый датасет - COMPOSITION CAP. Он включает в себя 18 различных композиционных атрибутов и предлагает три уровня детализации описаний:

- Attribute-Aware Regional Captioning - Описание конкретных атрибутов.

- Regional Dense Captioning - Плотное описание областей.

- Comprehensive Global Image Captioning - Глобальное описание изображения.

Этот датасет был сформирован на основе изображений из различных источников, включая Adobe Stock Images и iStock, с использованием модели SAM для получения масок объектов, а затем аннотирован людьми для создания соответствующих описаний.

Результаты и сравнение с существующими моделями

FINE CAPTION показывает значительные улучшения по сравнению с другими моделями Vision-Language в задачах, связанных с композиционным описанием изображений. Она превосходит такие модели, как LLaVA-1.6 и GPT-4, в точности и детализации описаний, особенно в задачах, требующих фокусировки на определённых областях изображения.

Заключение

FINE CAPTION представляет собой значительный шаг вперёд в области композиционного описания изображений. С её помощью становится возможным создавать описания, которые не только перечисляют объекты, но и передают их взаимосвязь, атрибуты и контекст, делая взаимодействие с визуальной информацией более интуитивным и естественным для пользователей.